Retomamos desde donde lo dejamos la vez anterior. Es muy complicado estar al día y como todo en la vida hay que elegir. Hoy traigo una selección de “noticias” y me humilde análisis de algunos temas puntuales.

Me interesan 2 puntos para pensarlos:

-¿Qué usos podemos darle en comunicación o medios a estas herramientas? Acá hay un ejemplo, publicado por el Laboratorio de Periodismo de la Fundación Luca de Tena sobre El Surti de Paraguay.

-¿Tenemos que sumarnos a todas las tendencias? Entendería que no, porque hay algunas (como la de la generación de videos) que tienen mucho que recorrer aún.

¿Cuál es tu opinión?

Buscadores y el nuevo SEO

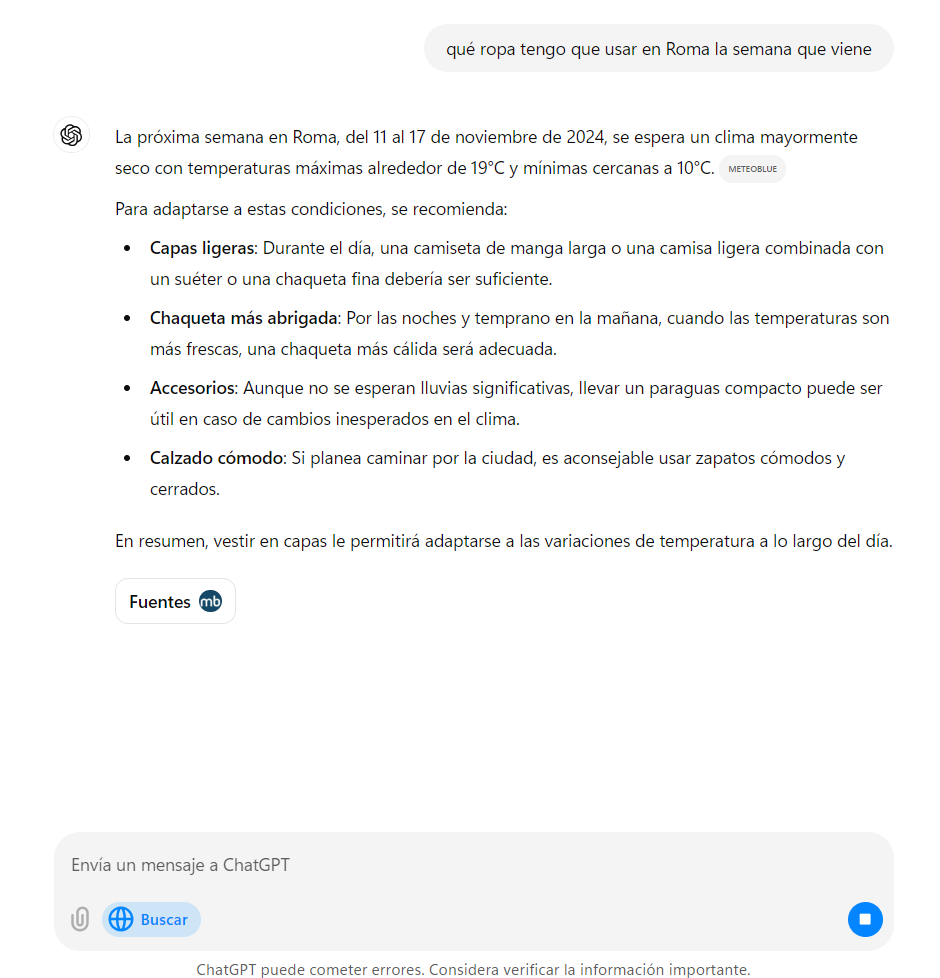

Y llegó el buscador de OpenAI, con una interfaz minimalista muuuuy parecida a la de Google, con sus “tendencias de búsqueda” y su contenido enriquecido para mostrar datos de forma más visual.

Era algo inevitable, principalmente porque algunos de los modelos podían buscar información en internet, por lo que este modelo “entrenado para buscar” termina de cerrar esa pequeña brecha que había con el Google tradicional o potenciado por Gemini y la gente de Perplexity.

Sin entrar mucho en detalle, la lógica del buscador es poder hacerle preguntas más complejas que resolverá en partes más pequeñas, por ejemplo:

O sea, tiene una dimensión temporal (sabe qué día es) y mezcla resultados:

-Busca el tiempo en Roma

-Busca tipos de ropa para ese tiempo

-Busca una forma de evitar errores diciendo “adaptarse a las variaciones…”

Parece que la tendencia es dividir en tareas pequeñas y luego unir todo, como hace O1.

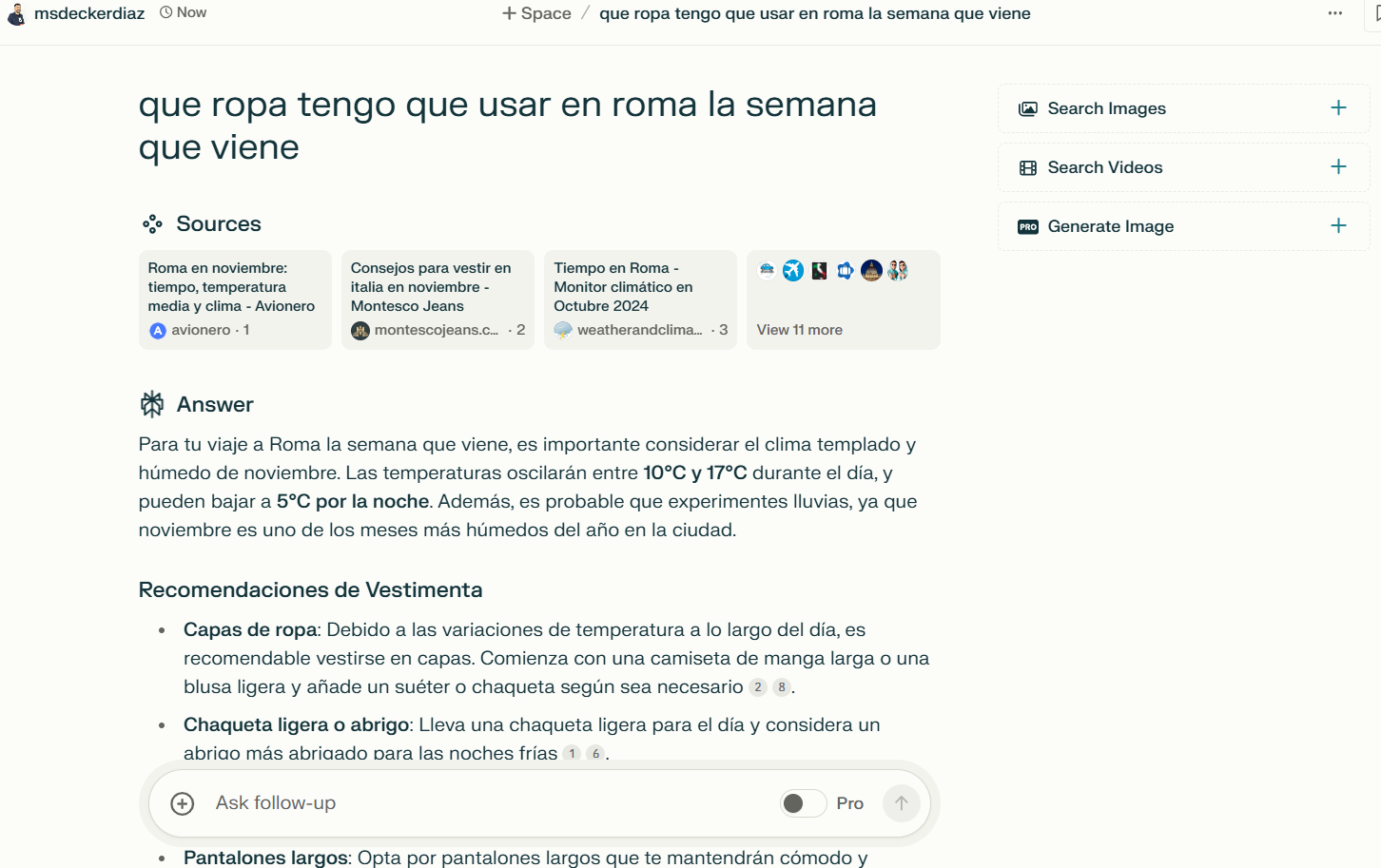

Si comparamos con los otros dos mencionados, Google claramente se queda atrás y Perplexity sigue en cabeza.

¿Qué tan buenos son?

Dicho esto, la verdad que en cuestiones específicas las selecciones de fuentes dejan mucho que desear. Por ahora pueden dar respuestas muy coherentes, pero si la información de base es mala… no hay mucho más que decir.

Estimo que esto es algo que se irá mejorando y que quizá para cuestiones no muy profundas (la de mi ejemplo) van a ser más que suficientes estos buscadores, pero para cuestiones más específicas o de investigación, el viejo y confiable Google aún tiene bastante para ofrecer.

¿De dónde salen los datos?

Aunque aseguran en OpenAI que tienen sus propios bots, está claro que Bing es la base de búsquedas (y también el bot base que aparece en el registro de los servidores) por lo que no sería mala idea a los especialistas SEO volver a poner un ojo en este buscador si lo tienen un poco descuidado.

Nosotros, en Tres Barbas, volvimos hace un par de semanas a prestarle atención a Bing y sus correcciones, así que si buscan mi nombre por ejemplo la referencia es mi propio sitio web.

Nota: estamos trabajando en un manual nuevo sobre SEO, si a varios de los lectores de este newsletter le interesa puedo compartirlo por acá (más la herramienta de Looker que hicimos).

¿Y los medios?

Varios editores importantes como AP, Reuters, Axel Springer y otros ya firmaron acuerdos de licencia de OpenAI, incluso para dar información en tiempo real, así que ellos están un paso adelantados a los que no.

Odio las reuniones

No todas, que quede claro, pero sí todas aquellas que cuando terminan dejan la sensación de: esto se podía resumir en un mail.

Por eso ya hace unos meses que tengo instaladas 4 herramientas para que entren a las reuniones por mí y me manden resúmenes (a veces simplemente no estoy) o en las que sí estoy tomen notas y me hagan un resumen.

Bueno, hoy traigo esa segunda versión y se llama Tactiq la idea es super sencilla: entras a Meet por Chrome y le decís si querés que trascriba o no (tenés 10 gratis al mes). Cuando termina te manda por mail la transcripción (en español mejoró mucho el último mes) y también un resumen o minuta.

No es perfecta, pero si tienen una reunión super aburrida de una hora y a los dos meses algún participante dice: “nunca prometimos esto”, bueno, acá tienen la transcripción. Basado en hechos reales.

Clonar voz

Acá nos ponemos más serios: cada vez es más fácil hacer una clonación de voz realista. Esto es muy peligroso, pero tenemos que saber que existe y también cómo se hace, porque sirve para estafas, desinformación y delitos varios.

La herramienta en cuestión se llama F5-TTS aunque funciona mejor dentro de los servidores de Huggingface. La idea es usar una muestra breve de audio y hacer que la IA lea con esa voz un texto que nosotros le demos. Por ahora está disponible en Inglés y Chino (la lectura) y en formato super breve, aunque ya hay algunos submodelos para español dando vueltas.

Galería de Prompts

Esto se me pasó en las versiones anteriores, pero si están usando Gemini pueden probar sus prompts en la Galería de Google o ver ejemplos para diferentes funciones.

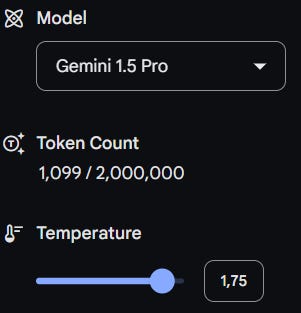

Te da además la posibilidad de probar (como sería en el playground de OpenAI) los mismos prompts con diferentes configuraciones o medir la cantidad de tokens (y por consiguiente el costo) de cada acción.

Diferentes modelos con sus costos y la temperatura: que se podría definir como la “creatividad del modelo”. En este caso está como demasiado creativo, lo que significa que tiene más riesgo de alucinar.

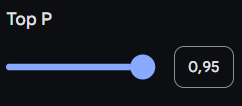

Y el Top P que es algo así como mantener las respuestas dentro de la posibilidad estadística. O sea, teniendo en cuenta el entrenamiento, la respuesta se va a centrar en la que tenga el 95 % de posibilidades de ser lo correcto. Por experiencia nada por abajo del 80 % es razonable salvo en casos en los que necesites que el modelo alucine.

En fin, es otra opción más para estudiar modelos, ver qué ofrecen, cuánto cuesta ($$$) conectarlo en nuestras aplicaciones, etc. Por ejemplo, nosotros los usamos para conectarlos en los bots de respuesta de servicios (por ejemplo de atención al cliente) o para muestras de arte donde cuentan la exposición. Con estas herramientas buscamos el tono justo y la flexibilidad del modelo más allá del prompt en cuestión.

Cursos gratis

Navegando encontré este sitio que tiene cursos gratis sobre IA, algunos están un poco desactualizados sobre las herramientas, pero para los conceptos están muy bien. Si haces alguno no te olvides de contarme qué te pareció.

Todo es PDF

La gente de Anthropic lanzó hace un par de días soporte PDF para su modelo Claude 3.5 Sonnet en beta pública, por lo que ahora puede analizar los documentos en texto y también las imágenes (si hay gráficos por ejemplo) contextualizarlas y “entenderlas”.

Por ahora tiene algunas limitaciones: 32MB por documento o 100 páginas, pero no hay tema al que se resista así que desde documentos legales a financieros hay capacidad.

Hay que ver cómo van evolucionando estas herramientas y cómo se va a llevar, en unos meses, con pruebas médicas. Recuerden que es un modelo generalista, si se entrena para detectar tumores, por ejemplo, los resultados van a ser mejores… Esto hace 6 meses estaba a disposición de grandes empresas nomás y laboratorios…

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Es algo súper íntimo y pueden no estar de acuerdo, pero creo que es una manera interesante de no solo decir “existe esto” si no “yo lo uso así” (o no).

Texto: GPT 4o o O1 (Versión de pago).

Video: no estoy usando ninguno.

Audio: Elevenlabs (Free) y Adobe Audition (Pago).

Imágenes: Dall-E 3 (Pago) y Adobe Photoshop (Pago).

Programación: GPT 4o (Canva o O1) y Claude (Gratis)

Buscador: Google.

Música: Suno.

Miscelánea: Endless.