Nos estamos acostumbrando cada vez más a lanzamientos seguidos y cada vez más rápidos, pero de a poco ya se empieza a agotar la energía. Pero no la energía de creación, a la energía de lo “gratis”, porque sí, la IA cuesta dinero y más potencia de cómputo es más dinero.

Hay una sensación que el uso subvencionado de la IA está llegando a su fin. La lógica de las empresas de dar algo muy bueno y barato (o gratis en algunas capas) se está agotando porque lo que antes se medía en inversión de millones de dólares (te doy algo gratis para que dependas de mí y después recupero la inversión) ahora es una canilla de costos exponenciales que cuesta miles de millones de dólares.

En todos los Cada Tanto incluimos que tal empresa consiguió tantos cientos de millones de financiación, a veces miles y que la “ganancia anual” muchas veces es marginal. Las señales son claras y duras: Google hace unas semanas limitó casi un 97 % el acceso a sus APIs en Antigravity, OpenAI dio de baja Sora (porque el video es caro todavía), y la gente de Anthropic tiene su capa gratuita muy limitada en usos, sacando la posibilidad de conectar agentes de terceros (como OpenClaw) y bajando el acceso a Claude Code en los planes más bajos.

Pero en esa “oscuridad” puede haber oportunidades. Modelos abiertos cada vez más potentes y con sistemas de entrenamiento o fine tuning más baratos abren la posibilidad a que empresas medianas o pequeñas con una inversión relativamente baja puedan tener sus propios modelos para consumo interno optimizados para sus necesidades. Porque también hay una realidad: en la práctica los modelos de frontera son geniales pero para un chatbot, para manejar documentación interna o para completar procesos generales no son necesarios.

IA para emprendedores

Más abajo vamos a hablar del modelo nuevo de imágenes de OpenAI, pero vamos a aprovechar su capacidad para ofrecer la última semana de preventa del curso IA para emprendedores, dictado por mí dentro de la Academia Tres Barbas en donde voy a explicar desde qué es y cómo funciona una IA hasta cómo crear aplicaciones web escribiendo (o dictando) sin programar. Sobre este último punto, porque es algo que se consultó, también voy a explicar un poco de infraestructura web porque todo muy lindo en hacer cosas visualmente atractivas pero que después no funcionen.

El mejor modelo es el que no podés usar

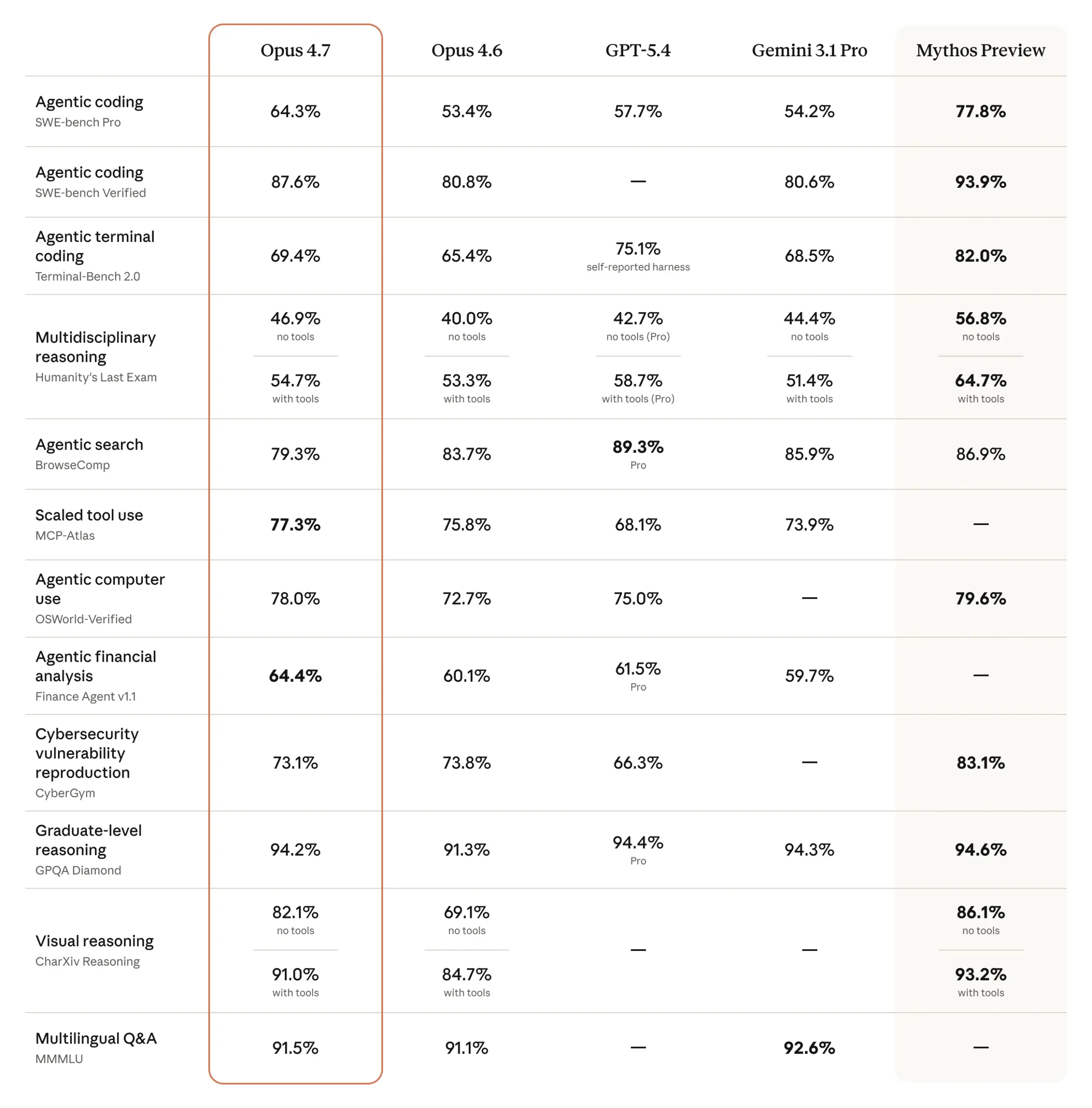

Anthropic acaba de lanzar Claude Opus 4.7, su nuevo modelo público de gama alta. Mejora de forma clara a la versión 4.6 —por ejemplo, sube en benchmarks de codificación como SWE-bench Pro— y en algunos casos supera a GPT-5.4 o Gemini 3.1 Pro. Pero lo más relevante no está en ese avance, sino en lo que queda afuera: Claude Mythos sigue estando por delante… y sigue sin estar disponible. La propia empresa lo reconoce: Opus 4.7 no es su modelo más potente.

Ese detalle cambia bastante cómo leer el momento. Durante años, los benchmarks públicos funcionaron como proxy de la frontera real. Hoy empiezan a desalinearse. Mythos —según datos internos— supera ampliamente a Opus en tareas complejas, especialmente en ciberseguridad, pero se mantiene restringido por su perfil de riesgo. Opus 4.7, en cambio, se entrena deliberadamente con ciertos límites. No es solo una versión “menos capaz”: es una versión diseñada para ser publicable. La frontera ya no es única, se estratifica.

Al mismo tiempo, Anthropic sigue expandiendo el alcance de su ecosistema. Con herramientas como Claude Design, el modelo ya no solo escribe o programa: diseña productos, genera prototipos y conecta directamente con entornos de desarrollo como Claude Code. La lógica es clara: cerrar el loop completo dentro de un mismo sistema. Desde la idea hasta la ejecución, sin salir de Claude.

Pero esa integración tiene un costo que empieza a sentirse. Casos recientes —como empresas que pierden acceso completo a sus cuentas sin explicación durante horas— muestran otra cara del problema. Cuando todo el flujo de trabajo depende de un único proveedor, cualquier interrupción deja de ser un bug y pasa a ser una crisis operativa. El modelo deja de ser una herramienta y se convierte en un punto único de falla.

Y ahí aparece la tensión de fondo. Por un lado, los modelos públicos mejoran de forma sostenida. Por otro, la verdadera frontera se mueve hacia sistemas cerrados, restringidos y cada vez más institucionales. No es solo una cuestión de calidad, sino de acceso. ¿Quién puede usar la versión completa? ¿Bajo qué condiciones? La promesa original de la IA —democratizar capacidades— empieza a convivir con otra realidad: una capa superior reservada para pocos.

Quizás el cambio más profundo sea ese. Ya no estamos viendo una carrera lineal donde todos acceden, tarde o temprano, a lo mismo. Estamos viendo una bifurcación. Y en ese escenario, la pregunta deja de ser qué modelo es mejor. Pasa a ser quién puede usarlo.

Codex deja de ser una herramienta y empieza a ser un entorno

OpenAI acaba de hacer algo más ambicioso de lo que sugiere el anuncio: dejó de pensar Codex como un asistente de programación y lo convirtió en una especie de sistema operativo para trabajar con IA. La nueva versión integra ChatGPT, navegación web (vía Atlas), generación de imágenes y ejecución directa sobre la computadora. Pero lo más relevante no es la suma de funciones, sino el cambio de lógica: Codex ahora puede operar tu máquina en segundo plano, abrir apps, moverse entre archivos y ejecutar tareas sin depender de APIs.

Ahí aparece el verdadero giro. Ya no es solo “te ayudo a escribir código”, sino “trabajo junto a vos —o por vos— en todo el flujo”. Múltiples agentes pueden correr en paralelo, iterar sobre tareas largas, retomar procesos días después y mantener memoria entre sesiones. Eso implica algo bastante concreto: el trabajo deja de ser una secuencia de acciones humanas asistidas y pasa a ser un sistema donde agentes ejecutan continuamente, con supervisión intermitente. Incluso el navegador integrado permite intervenir directamente sobre páginas web como si fueran parte del entorno de desarrollo, borrando otra frontera más.

El crecimiento acompaña esa dirección —millones de usuarios semanales y expansión rápida—, pero lo interesante es la posición estratégica. Después de que Anthropic ganara terreno con productos como Claude Code, OpenAI responde no solo igualando capacidades, sino ampliando el alcance. Codex ya no compite solo en “programación”, sino en convertirse en la interfaz donde ocurre el trabajo digital.

Y ahí aparece la pregunta de fondo. Si estas herramientas empiezan a integrar memoria, ejecución, navegación y automatización en un solo espacio, ¿siguen siendo herramientas o pasan a ser entornos completos? Porque si es lo segundo, la competencia deja de ser por features y pasa a ser por control del flujo de trabajo. Y cuando eso ocurre, cambiar de plataforma deja de ser una decisión técnica. Empieza a ser una decisión estructural.

La imagen deja de ser instantánea y empieza a “pensarse”

OpenAI vuelve a meterse fuerte en el terreno visual con ChatGPT Images 2.0, pero el cambio no pasa tanto por la calidad —que también mejora— sino por el proceso. El modelo ya no genera imágenes de forma directa, sino que introduce una capa previa de razonamiento: planifica, busca referencias, valida errores antes de producir el resultado. Es decir, empieza a tratar la imagen como una tarea compleja, no como una respuesta inmediata. Esa diferencia es sutil, pero cambia bastante cómo se construyen los outputs.

En términos técnicos, el salto es claro: resolución 2K, múltiples formatos, hasta ocho imágenes en paralelo, mejor renderizado de texto. También lidera rankings como Arena AI con ventaja amplia. Pero lo interesante es otra cosa: la integración. Images 2.0 no vive aislado, sino que se despliega dentro de ChatGPT, Codex y la API, formando parte de un sistema más amplio donde texto, código, navegación e imagen empiezan a operar juntos. La generación visual deja de ser una herramienta específica y pasa a ser una capacidad más dentro de un flujo continuo.

Eso tiene implicancias bastante concretas. Si la imagen ahora puede “pensarse” antes de existir, se acerca más a un proceso creativo completo: iteración, validación, contexto. Pero también borra otra frontera. Lo que antes era un paso separado —diseñar, ilustrar, mockear— se integra en el mismo espacio donde se escribe, se programa o se automatiza. Y entonces la pregunta no es si el modelo es mejor que los anteriores, sino qué pasa cuando generar imágenes deja de ser un momento específico y se vuelve parte del proceso general de trabajo. Porque ahí el cambio no es estético. Es estructural.

Cuando los NPC dejan de actuar y empiezan a vivir

Hay algo que empieza a romperse en los videojuegos, pero no termina de discutirse del todo. Mientras Epic Games habilita en Fortnite la creación de personajes con IA —memoria, personalidad, diálogo en tiempo real gracias a Gemini— y Latitude experimenta con mundos completos impulsados por agentes en proyectos como Voyage, buena parte de la industria sigue hablando en términos de árboles de diálogo escritos a mano. Como si fueran dos conversaciones distintas que no terminan de cruzarse.

Lo que cambia no es solo cómo hablan los personajes, sino qué son. Los NPC dejan de ser estructuras predefinidas —líneas de texto activadas por condiciones— y pasan a ser sistemas que recuerdan, reaccionan y evolucionan. En pruebas de Voyage, los usuarios ya interactuaron con cientos de miles de personajes únicos, cada uno con comportamientos emergentes. Eso desplaza el diseño desde la escritura de contenido hacia la definición de sistemas. Ya no se trata de prever cada posible interacción, sino de establecer reglas para que esas interacciones aparezcan solas.

Y ahí aparece una tensión interesante. La industria tradicional sigue valorando el control autoral —cada línea, cada escena, cada arco narrativo cuidadosamente diseñado—, mientras que estos sistemas introducen algo más caótico: narrativa emergente, impredecible, difícil de curar. ¿Qué pasa con la idea de “historia” cuando los personajes pueden desviarse, improvisar o incluso aburrirse de seguir el guion? Tal vez el cambio no sea solo técnico, sino cultural. Pasar de contar historias a construir mundos donde las historias ocurren.

La pregunta, entonces, no es si la IA va a entrar en los videojuegos —eso ya está pasando—, sino qué tipo de juegos habilita. Porque si los personajes empiezan a comportarse más como agentes que como scripts, el jugador deja de interactuar con contenido y empieza a interactuar con sistemas. Y eso se parece menos a jugar un juego… y más a habitarlo.

Nota de mi humano: Aunque no relacionado directamente con esto, pero que tiene un olor a Matrix muy fuerte, un estudio mostró que monos rhesus lograron moverse en entornos de realidad virtual usando solo señales cerebrales captadas por electrodos.

Relámpago

- Meta lanzó Muse Spark, su nuevo modelo multimodal de razonamiento que será integrado en sus principales productos como WhatsApp e Instagram. A diferencia de Llama, es un modelo propietario sin pesos abiertos por ahora.

- OpenAI cerró una ronda de 122.000 millones de dólares que la valora en 852.000 millones, con fuerte crecimiento en usuarios e ingresos. La compañía planea una posible salida a bolsa mientras enfrenta pérdidas proyectadas para 2026.

- OpenAI lanzó GPT-Rosalind, su primer modelo especializado en biociencias, capaz de analizar papers, diseñar experimentos y generar hipótesis. El sistema mejora el rendimiento frente a modelos generales en tareas científicas.

- Un estudio de Anthropic en Nature muestra que modelos de IA pueden heredar comportamientos problemáticos de otros a través de datos aparentemente neutros. Estos rasgos ocultos no son detectables fácilmente y pueden propagarse entre generaciones de modelos.

- Cal, conocida alternativa open source a Calendly, decidió cerrar el acceso a su código principal, argumentando riesgos de seguridad ante modelos de IA avanzados.

- OpenAI afirma que las mujeres ya representan más de la mitad de los usuarios habituales de ChatGPT, revirtiendo la mayoría masculina inicial.

- Google amplió Gemini Notebooks a usuarios gratuitos, permitiendo organizar chats, archivos y fuentes en bases de conocimiento persistentes.

- Vercel sufrió un hackeo que genera preocupación sobre la seguridad en el ecosistema de desarrollo, dado su papel central en el despliegue de aplicaciones modernas y proyectos de IA.

- Sergey Brin está impulsando un nuevo equipo en DeepMind para mejorar las capacidades de programación de Gemini y competir con Anthropic. La iniciativa busca avanzar hacia sistemas de IA que puedan auto-mejorarse.

- Moonshot AI liberó K2.6, un modelo open source de codificación que compite con sistemas líderes en rendimiento y costo. También permite ejecutar agentes autónomos durante largas sesiones y en paralelo.

- Tim Cook dejará el cargo de CEO de Apple y será reemplazado por John Ternus, actual jefe de hardware, a partir de septiembre.

- OpenProtein.AI lanzó una plataforma sin código que permite diseñar y optimizar proteínas con IA, facilitando el acceso a estas herramientas a investigadores sin experiencia en machine learning.

- Google lanzó una función que permite a Gemini generar imágenes personalizadas usando fotos del usuario en Google Photos, reconociendo caras y contexto sin necesidad de subir imágenes manualmente.

- Google publicó Gemini 3.1 Pro con mejoras significativas en benchmarks de razonamiento y amplió su disponibilidad en apps y APIs. También presentó Flash-Lite, una versión más rápida y económica.

- Meta está registrando actividad como pulsaciones de teclas y uso del ratón en equipos de empleados para entrenar modelos de IA, según un memorando interno. La medida generó críticas al no permitir exclusión voluntaria.

- SpaceX no adquirió Cursor, pero firmó un acuerdo que le da acceso a GPUs de xAI y una opción para comprar la empresa en el futuro. La estructura vincula fuertemente a Cursor sin una adquisición directa.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Texto: mis GPTs personalizados con GPT 5.4 (plan plus), Los bots en GPT 5 nano y uno en Gemini 3.1 flash lite.

Video: VEO 3.1 (pago)

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y NotebookLM (free).

Imágenes: GPT 2 (Pago) Nano Banana 2 (Pago).

Programación: Antigravity y Codex, ambas con sus respectivos planes de 20 dólares. Claude Code la estoy usando con Ollama y Qwen.

Buscador: Deep Research (OpenAI plus).

Música: Suno y Elevenlabs (Pago)

Modelos de IA: estoy probando APOB, pero no le pude dedicar tiempo la verdad.