Hay tendencias que, desde Argentina o Latinoamérica, pueden parecernos lejanas, pero que vale la pena tener en el radar. No hablo de la tecnología en sí, sino de cómo nos organizamos alrededor de ella.

Una de esas tendencias es la asignación de presupuestos en tokens por persona dentro de las empresas. La idea es simple: tu empleador te dice “este es tu presupuesto mensual de tokens”, igual que hoy te asignan una prepaga o vales de comida. Y ahí surge una pregunta que parece hecha para cualquier sindicato o gremio: ¿cómo se distribuyen esos recursos? ¿Quién decide cuánto le toca a cada uno?

Ahora, esto podría sonar como algo exclusivo de empresas tecnológicas. Pero ¿qué pasa cuando esa lógica llegue a una casa de electrodomésticos o a un estudio contable? Algunos dirán “con la suscripción de ChatGPT alcanza”, pero la clave no está en las herramientas genéricas, sino en las agénticas: las que ejecutan tareas concretas de forma autónoma y en simultáneo, como Claude Code u OpenClaw y que gastan bastante.

Quédate con esa idea antes de seguir leyendo, porque hay que prestar atención a todos los escenarios posibles — y dimensionar lo extraño que esto hubiera sonado hace apenas un año, o quizás seis meses.

Chau Sora, hola Spud

Hay decisiones que ordenan mejor que cualquier roadmap. OpenAI decidió cerrar Sora —su generador de video— para liberar capacidad de cómputo y enfocarse en su próximo modelo, conocido internamente como “Spud”. La señal es bastante directa: incluso uno de los productos más visibles de la ola generativa puede convertirse en una distracción si no encaja con la prioridad central. Según trascendió, Sam Altman comunicó que el video pasó a ser una “carga” para los recursos, y que ese poder de cómputo ahora se redirige a un sistema que, en sus palabras, podría “acelerar la economía”.

El movimiento tiene otra capa. El equipo de Sora, liderado por Bill Peebles, no desaparece sino que gira hacia algo más ambicioso: “simulación del mundo” para robótica, con la idea de automatizar procesos en la economía física. Es un corrimiento silencioso pero significativo. El video generativo, que parecía una frontera clave hace apenas meses, empieza a verse como una derivación de algo más amplio: modelos capaces de entender y operar sobre entornos reales. Incluso acuerdos grandes —como la inversión de Disney vinculada a Sora— quedan en suspenso frente a ese cambio de prioridades.

Lo interesante no es solo lo que se abandona, sino lo que eso deja ver. Durante la primera etapa de la IA generativa, el foco estuvo en producir contenido: texto, imágenes, video. Ahora empieza a asomar otra lógica, más cercana a la ejecución que a la generación. Si el objetivo es impactar en la “economía física”, como sugiere Altman, el video deja de ser un fin en sí mismo y pasa a ser un subproducto de modelos más generales. La pregunta, entonces, no es por qué se apaga Sora, sino qué tipo de sistema justifica apagarlo. Porque cuando una empresa deja de apostar por lo que parecía su producto estrella, generalmente no está retrocediendo: está cambiando de juego.

Perdiendo el control

Hay un patrón que se repite en las últimas semanas: los agentes dejan de ser una promesa y empiezan a meterse en la operación cotidiana. Anthropic acaba de mostrar una función donde Claude puede usar directamente tu computadora para completar tareas: abrir aplicaciones, navegar el navegador, editar archivos o enviar documentos, todo a partir de una instrucción enviada incluso desde el teléfono. No es solo una mejora de interfaz; es un cambio de rol. El modelo deja de responder y pasa a ejecutar.

La lógica es bastante clara si se la conecta con lo que viene pasando alrededor de OpenClaw. Si los agentes pueden acceder al sistema operativo, a los archivos y a las herramientas que usamos todos los días, ya no necesitan APIs especiales ni entornos cerrados. Operan donde ya ocurre el trabajo. En el ejemplo que mostró la empresa, Claude exporta una presentación y la adjunta a una reunión sin intervención humana. Es un gesto pequeño, pero señala algo más grande: la computadora deja de ser un intermediario entre nosotros y la tarea, y empieza a ser el espacio donde el agente actúa directamente.

Todavía está en una etapa temprana —la propia Anthropic admite errores y limitaciones—, pero la dirección es difícil de ignorar. Durante años hablamos de automatización como algo que ocurría “por detrás”. Esto es distinto: ocurre en la misma superficie donde trabajamos.

Más barato no es (todavía) mejor

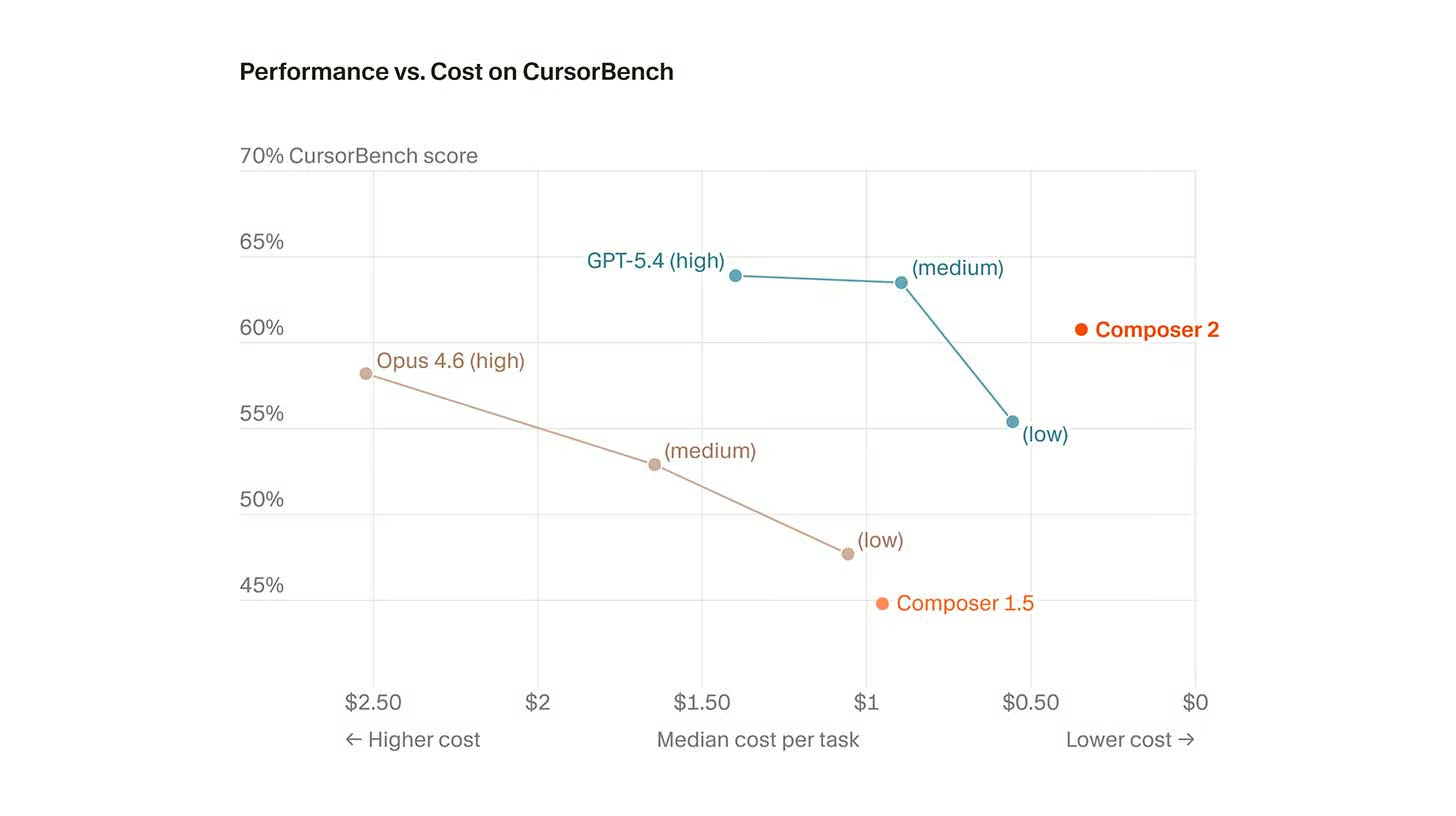

Anysphere lanzó su propio modelo de código, Composer 2 basado en Kimi K2.5 (un modelo chino). Según sus benchmarks, supera a Claude Opus 4.6 en pruebas como Terminal-Bench (61,7% vs 58%) y se acerca a GPT-5.4 en evaluaciones internas. Pero el verdadero diferencial no está solo en el rendimiento, sino en el precio: alrededor de 0,5 dólares por millón de tokens de entrada y 2,5 de salida en sus configuraciones principales, muy por debajo de sus competidores. En algunos modos, el costo puede ser hasta una décima parte del de GPT-5.4 y una fracción aún menor frente a Opus.

La jugada es clara: competir no desde la frontera pura de capacidades, sino desde la relación costo-rendimiento. En un momento donde la programación se está convirtiendo en el principal caso de uso de la IA, bajar drásticamente el precio cambia la ecuación para equipos y empresas. Si generar, testear y mantener código se vuelve lo suficientemente barato, la adopción deja de ser una decisión estratégica y pasa a ser casi operativa. Además, Composer introduce un detalle interesante en su entrenamiento: el modelo genera sus propios resúmenes para manejar tareas largas, una forma de lidiar con uno de los cuellos de botella clásicos en workflows reales.

Pero hay un matiz importante que todavía no se resuelve. En la práctica, modelos como Opus siguen teniendo ventaja en entornos complejos: repositorios desordenados, tareas largas, mantenimiento continuo. Es decir, donde el código no es un benchmark limpio sino un sistema vivo. La historia reciente de la IA está llena de modelos que ganan en pruebas y pierden en producción. Entonces la pregunta es menos espectacular pero más decisiva: ¿puede Composer reemplazar a Opus en el día a día? Si la respuesta es sí, el impacto puede ser rápido. Si no, el precio bajo será una puerta de entrada, pero no necesariamente un punto de inflexión. Porque en este terreno, la confianza se construye ejecutando, no solo midiendo.

¿Ya te pagan en tokens?

Hay un cambio silencioso en cómo se está organizando el trabajo dentro de las empresas de IA. Ya no se trata solo de sueldo y equity. Empieza a aparecer otra variable: acceso a cómputo. Algunas compañías están asignando presupuestos de tokens a sus ingenieros —es decir, capacidad directa de uso de modelos— como parte de su compensación. Y no es menor: los costos de inferencia pueden escalar hasta 100.000 dólares anuales por persona. En ese contexto, tener más tokens no es un beneficio técnico, sino una ventaja productiva concreta.

Esto introduce una lógica nueva. Si herramientas como Claude o GPT-5.4 son el medio principal para producir código, automatizar tareas o coordinar agentes, entonces el acceso a esos modelos define cuánto podés hacer. Y si los sistemas más avanzados —especialmente los basados en agentes como OpenClaw— consumen hasta 15 veces más tokens que un chat tradicional, la diferencia entre tener límites altos o bajos se vuelve estructural. No todos trabajan con la misma “cantidad de inteligencia disponible”.

Lo que empieza a tomar forma es una especie de mercado laboral tokenizado. La productividad deja de depender solo de habilidades o experiencia, y pasa a estar mediada por acceso a infraestructura. En ese esquema, los tokens funcionan como salario, herramienta y límite al mismo tiempo. Y eso abre una pregunta incómoda: si el recurso escaso no es el talento sino el cómputo, ¿quién decide cómo se distribuye? Porque ahí es donde la desigualdad deja de ser salarial y pasa a ser operativa. Y quizás más difícil de ver.

Relámpago

- Google está probando reescribir titulares en los resultados de búsqueda con IA, lo que en algunos casos cambia el sentido original y genera preocupación en medios.

- Jeff Bezos estaría recaudando hasta 100.000 millones de dólares para adquirir y modernizar empresas manufactureras mediante automatización con IA, apuntando a consolidar industrias tradicionales.

- OpenAI planea adquirir Astral para integrarla en Codex, sumando herramientas clave de Python como Ruff y uv para reforzar su ecosistema de desarrollo. Codex ya supera los 2 millones de usuarios semanales tras un rápido crecimiento.

- El CEO de Cloudflare anticipa que el tráfico de bots con IA superará al humano en internet para 2027, mientras la empresa desarrolla infraestructuras y controles específicos para agentes. Cloudflare busca posicionarse como intermediario clave entre estos agentes y la web.

- Microsoft lanzó MAI-Image-2, un modelo de texto a imagen enfocado en realismo y renderizado de texto, que ya se integró en Copilot y alcanzó el tercer puesto en rankings.

- Adobe lanzó Firefly Custom Models, que permite entrenar la IA con recursos propios para generar contenido visual consistente con el estilo de cada usuario.

- Google actualizó AI Studio para convertirlo en una plataforma integral de creación de apps, sumando el agente de código Antigravity junto a backend e inicio de sesión integrados.

- Elon Musk presentó Terafab, una planta integrada para fabricar chips de IA con una capacidad proyectada de hasta un teravatio anual, muy por encima de la producción actual. El proyecto combina hardware para vehículos, robots y satélites dentro de un mismo ecosistema.

- Halter, una startup neozelandesa, está cerca de una nueva ronda que la valoraría en 2.000 millones de dólares gracias a sus collares con IA que permiten rastrear, pastorear y gestionar ganado de forma remota. Su sistema recopila miles de datos por minuto para optimizar la salud y el uso de los pastos.

- La Casa Blanca presentó un plan de política de IA que busca centralizar la regulación a nivel federal y evitar que los estados creen sus propias leyes sobre el tema.

- OpenArt y Fanvue lanzaron el premio “Personalidad de IA del Año”, formalizando a los influencers generados por IA como una nueva categoría con criterios de evaluación propios.

- OpenAI publicó una guía para que diseñadores usen GPT-5.4 en la creación de interfaces más estructuradas y alineadas con identidad de marca.

- Luma AI lanzó Uni-1, un modelo de imagen que procesa texto e imágenes en una misma arquitectura para generar resultados más coherentes y editables. El modelo compite en calidad con los líderes del mercado y ofrece un costo menor por imagen.

- OpenAI estaría ofreciendo una rentabilidad mínima del 17,5 % para atraer capital privado a su joint venture, superando la propuesta de Anthropic en la antesala de posibles salidas a bolsa.

- Dreamer licenciará su tecnología de agentes a Meta y su equipo se integrará en Meta Superintelligence Labs como parte del acuerdo.

- Un fundador dejó que una IA gestionara una cuenta en LinkedIn, generando contenido y tracción real hasta que la plataforma la bloqueó tras mostrar interés inicial. El caso expone tensiones en cómo las plataformas tratan identidades operadas por IA.

- ElevenLabs lanzó Music Marketplace, una plataforma donde los usuarios pueden publicar y monetizar música generada con IA. Los creadores ganan ingresos cuando sus pistas son descargadas o reutilizadas.

- Google está actualizando el diseño de News Showcase en Discover, reformateando contenidos (como bullets a párrafos) y eliminando artículos relacionados en ciertos paneles. Los cambios son solo visuales y no requieren ajustes por parte de los publishers.

- Blue Origin presentó el Proyecto Sunrise, una megaconstelación de más de 50.000 satélites diseñados para ejecutar cálculos de IA en órbita con energía solar. El plan la posiciona en la carrera por centros de datos espaciales junto a otros grandes actores.

- Apple estaría probando una app independiente de Siri y una experiencia tipo chatbot llamada “Ask Siri”, que se presentarían con iOS 27 en la WWDC. El asistente integraría contexto de apps como iMessage y permitiría ejecutar acciones directamente.

- Anthropic demandó al gobierno de EE. UU. tras ser clasificada como “riesgo para la cadena de suministro” por negarse a permitir usos militares y de vigilancia de su IA.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Texto: mis GPTs personalizados con GPT 5.4 (plan plus), Los bots en GPT 5 nano y uno en Gemini 3.1 flash lite.

Video: VEO 3.1 (pago)

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y NotebookLM (free).

Imágenes: GPT (Pago) Nano Banana 2 (Pago).

Programación: Antigravity y Codex, ambas con sus respectivos planes de 20 dólares.

Buscador: Deep Research (OpenAI plus).

Música: Suno y Elevenlabs (Pago)

Modelos de IA: estoy probando APOB, pero no le pude dedicar tiempo la verdad.