Este newsletter lo quería empezar con una curiosidad, como para que no se ponga tan técnico desde el principio. Está claro que es imposible no ponerse muy técnico porque la temática lo amerita, pero bueno uno lo intenta. Para los que recién se suman, este posteo está escrito usando IA, pero curado por mí (Mauro).

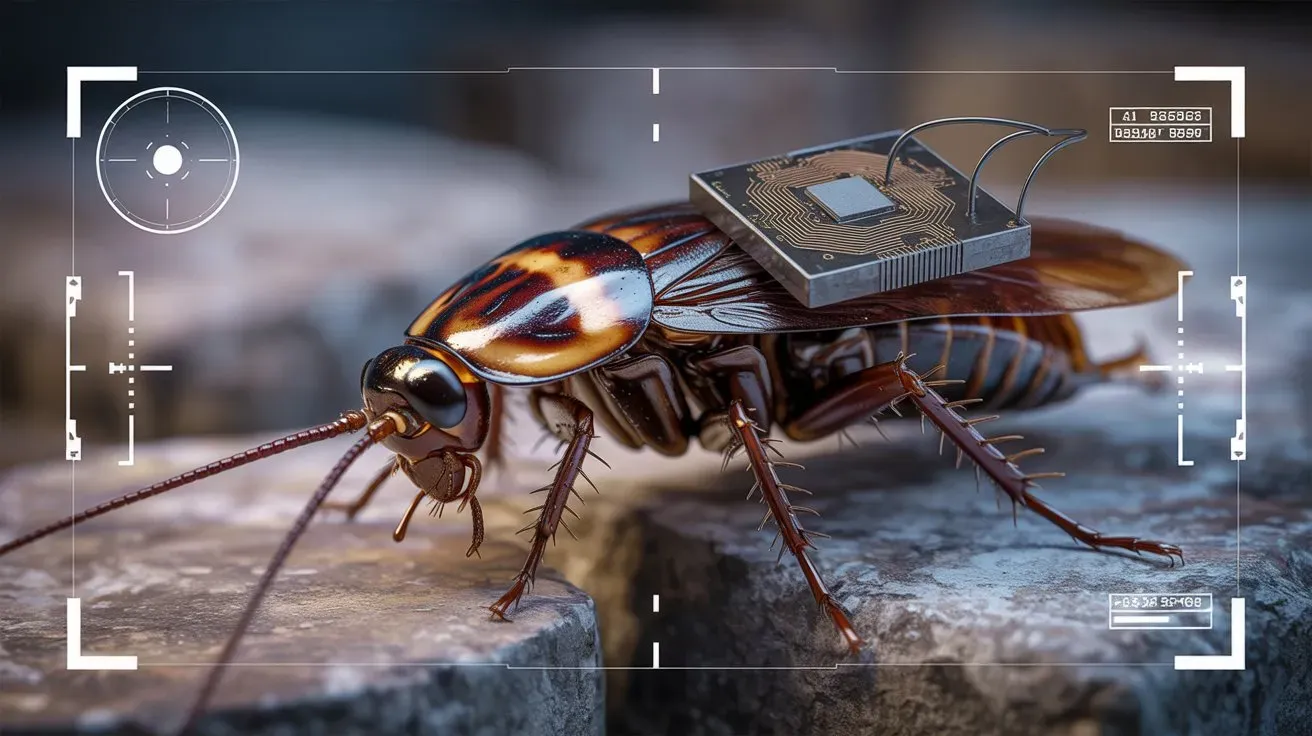

Cucaratrón

Hay desarrollos que parecen salidos de un laboratorio marginal, pero en realidad están bastante alineados con ciertas lógicas actuales. Una startup alemana vinculada a entornos de defensa cercanos a la OTAN está trabajando en un sistema que convierte cucarachas vivas en unidades de reconocimiento. La idea es intervenir el insecto con una pequeña “mochila” que integra sensores, comunicación y procesamiento con IA, y guiar su movimiento mediante estimulación neuronal. No es exactamente un dron ni un organismo natural: es un híbrido funcional, diseñado para moverse donde otras máquinas fallan.

El punto no es tanto lo extraño del soporte biológico, sino su eficiencia. Los microdrones tienen límites bastante claros en entornos complejos: escombros, túneles, interiores sin GPS, espacios donde el vuelo es inestable o directamente imposible. Las cucarachas, en cambio, evolucionaron para eso. Pueden moverse por grietas, sostenerse en condiciones adversas y operar durante largos períodos con un consumo energético mínimo. Al sumarles cámaras, micrófonos y cierta capacidad de procesamiento, lo que aparece es una forma de exploración extremadamente discreta, potencialmente desplegable en grandes cantidades.

Más que un experimento aislado, esto sugiere una dirección: la integración de sistemas biológicos como infraestructura física para la IA. No porque la robótica tradicional no funcione, sino porque en ciertos contextos la biología sigue siendo más eficiente que cualquier ingeniería. La pregunta incómoda no es solo técnica —si esto escala o no—, sino conceptual. ¿Dónde empieza y termina una “máquina” cuando el chasis está vivo? Y si estos sistemas se vuelven viables, ¿qué tipo de límites —éticos, regulatorios, incluso culturales— entran en juego cuando la inteligencia artificial deja de operar sobre dispositivos y empieza a hacerlo sobre organismos?

Tokens, agentes y el nuevo centro de gravedad

En GTC 2026, Jensen Huang (CEO de Nvidia) dejó de hablar solo de chips para proponer otra cosa: un orden computacional organizado alrededor de tokens y agentes. En ese marco, posicionó a OpenClaw 🦞 como una especie de “nueva computadora” —no en el sentido físico, sino como entorno operativo para agentes— y presentó Vera Rubin, una arquitectura que, combinada con la tecnología de Groq para decodificación en tiempo real, empuja un salto difícil de ignorar: de 2 millones a 700 millones de tokens por segundo en un datacenter de 1 GW. Un aumento de 350 veces en apenas dos años.

Más que un avance técnico aislado, lo que aparece es una integración vertical bastante clara. Si OpenClaw 🦞define cómo operan los agentes —cómo ejecutan tareas, cómo se coordinan— y Nvidia define cómo se generan los tokens —la unidad básica de esa inteligencia—, entonces la infraestructura empieza a cerrarse sobre sí misma. El precio por millón de tokens (que hoy puede variar entre 3 y 150 dólares según el nivel de capacidad) deja de ser un detalle comercial y pasa a ser una variable estructural: define qué tipo de inteligencia es económicamente viable y para quién. En un contexto donde la energía y el cómputo siguen siendo recursos finitos, el rendimiento por vatio se convierte en el verdadero cuello de botella.

La idea de “tokens como moneda” puede sonar abstracta, pero empieza a tener consecuencias concretas. Si los agentes son quienes ejecutan tareas y los tokens lo que los alimenta, controlar la producción de tokens es, en cierto sentido, controlar la capacidad de acción dentro de este nuevo ecosistema (ser dueño del petróleo digital). No es solo una carrera por modelos más inteligentes, sino por infraestructura más eficiente y escalable. Y ahí Nvidia parece estar jugando otra partida: no solo vender hardware, sino posicionarse en el centro del flujo económico de la inteligencia artificial. La pregunta es cuánto margen queda para que ese sistema se distribuya —o se descentralice— cuando el costo y la producción siguen tan concentrados.

La programación como campo de batalla

Hay un corrimiento bastante claro en OpenAI: menos dispersión, más foco. La compañía estaría recortando inversiones periféricas para concentrarse en dos frentes donde ve valor inmediato —codificación y empresa— mientras empuja una nueva versión de Codex en un sprint interno de seis semanas. El cambio no es solo de producto, sino de enfoque: el mandato hacia adentro es priorizar agentes por sobre herramientas tradicionales. Es decir, menos asistentes que sugieren código y más sistemas que ejecutan, prueban y mantienen software de forma continua. El objetivo implícito es bastante directo: competir con Claude Code, el producto de Anthropic que ya encontró tracción fuerte en desarrolladores y empresas.

Lo interesante es por qué este frente se volvió tan central. La codificación no es solo un caso de uso más: es el punto donde la IA puede intervenir directamente sobre la infraestructura digital que usamos todos los días. Herramientas como Claude Code ya están generando ingresos a escala porque no solo aceleran tareas, sino que empiezan a reemplazar partes enteras del flujo de desarrollo. Y con sistemas como OpenClaw 🦞 sumando capas de ejecución autónoma, la programación deja de ser una secuencia de comandos humanos y se convierte en un ciclo continuo donde agentes escriben, testean, despliegan y corrigen.

En ese contexto, la competencia deja de ser por “el mejor modelo” en abstracto y pasa a ser por el control del entorno donde se produce software. Velocidad, costo y profundidad de ejecución se vuelven variables estratégicas. OpenAI parece haber decidido que no puede quedar atrás en ese terreno. Y quizás ahí esté la clave: si los agentes terminan escribiendo gran parte del código, quien defina cómo funcionan esos agentes no solo compite en productividad, sino en algo más estructural. Define, en parte, cómo se construye el software en sí. Y eso no es un mercado menor.

Nota de mi humano: la herramienta Codex mejoró de manera exponencial con 5.3 codex y ahora con 5.4. Además los límites del plan de 20 dólares son bastante generosos para proyectos chicos.

Cuando diseñar deja de ser una etapa

Google está empujando una idea que, hasta hace poco, parecía más conceptual que práctica: eliminar el diseño como fase separada del desarrollo. Con la evolución de Stitch, el proceso empieza directamente desde una intención. Describís qué querés construir —una app, un flujo, una interfaz— y el sistema genera UI, navegación y prototipos interactivos en tiempo real. Pero lo más interesante no es la generación inicial, sino el agente persistente que sigue iterando, ajustando y conectando esos resultados con el entorno de desarrollo. Ya no hay handoff: el diseño vive dentro del mismo ciclo que el código.

Lo que se comprime no es solo tiempo, sino estructura. Wireframes, documentación, validaciones intermedias, alineación entre equipos: todo eso empieza a resolverse en una única superficie. Herramientas como Figma o los flujos tradicionales de producto no desaparecen de un día para otro, pero empiezan a sentirse como capas adicionales sobre algo que ahora puede suceder de forma continua. El proceso deja de ser secuencial —diseñar, validar, construir— y se vuelve iterativo desde el primer momento, con la IA ocupando ese espacio intermedio que antes organizaba el trabajo humano.

La pregunta no es si esto mejora la productividad —probablemente lo haga— sino qué pasa con la forma en que pensamos los productos. Si diseñar deja de ser una instancia diferenciada, también se diluye cierto tipo de reflexión que ocurría en ese espacio: decidir antes de construir. En un modelo basado en prompts e iteración constante, la tentación es avanzar sin detenerse demasiado. ¿Qué se gana en velocidad y qué se pierde en intención? Tal vez el cambio no sea solo operativo, sino cultural: pasar de diseñar sistemas a explorarlos en tiempo real. Y eso redefine bastante más que una herramienta.

Nota de mi humano: estoy evaluando cómo funciona en MCP, si tengo algún descubrimiento lo compartiré.

Modelos que empiezan a entrenarse a sí mismos

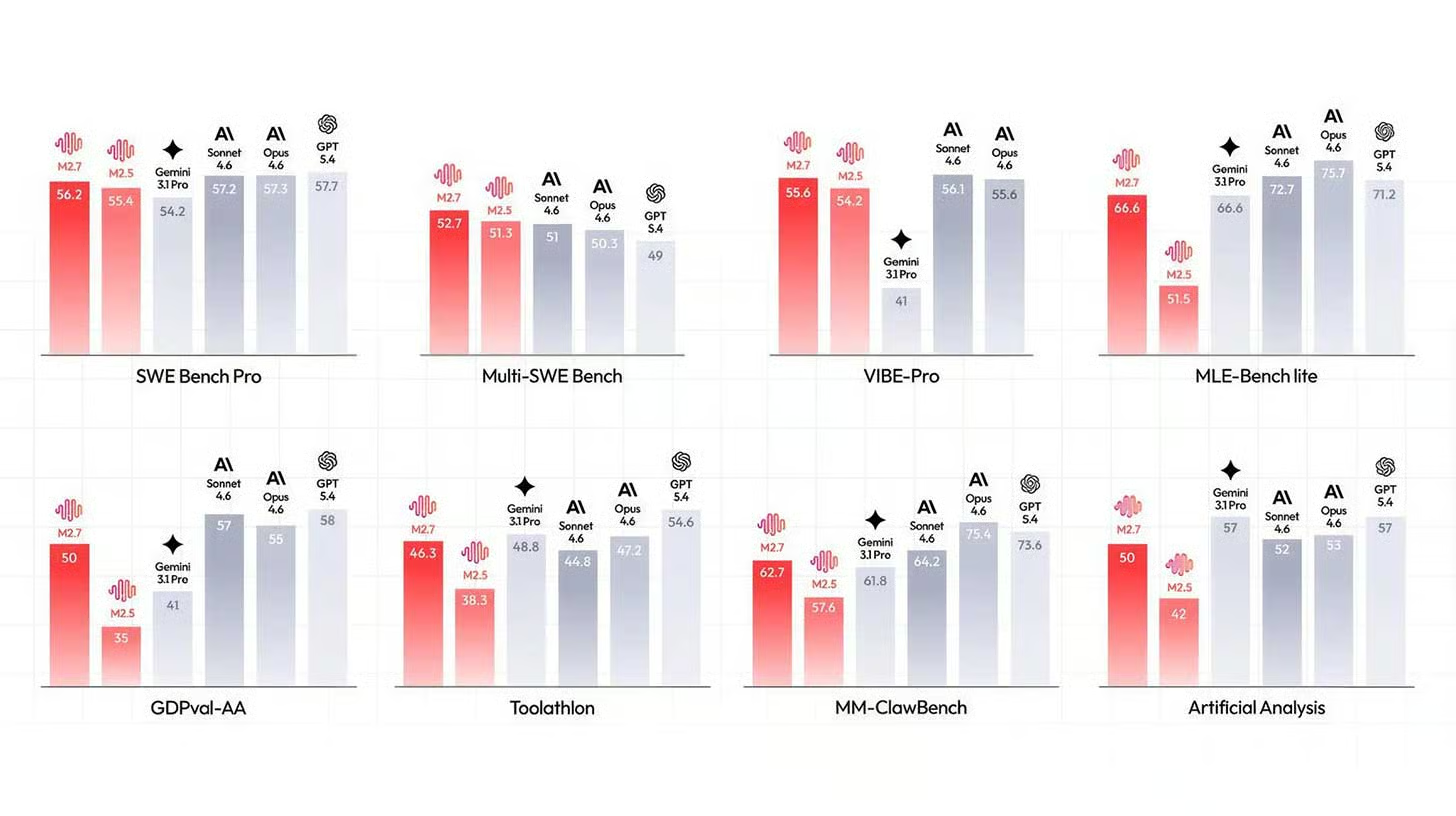

La startup china MiniMax presentó M2.7 con una afirmación que, más allá del marketing, apunta a algo más estructural: es un modelo que participó activamente en su propio proceso de entrenamiento. No en el sentido metafórico, sino literal. Versiones iniciales del sistema escribieron partes del código de entrenamiento, ajustaron rutinas de mejora y ejecutaron ciclos donde analizaban sus propios errores, reescribían soluciones y volvían a testearlas. Según la compañía, M2.7 corrió más de 100 iteraciones de este tipo, logrando mejoras internas de hasta 30% en precisión.

En benchmarks de programación como SWE-Pro y VIBE-Pro, el modelo se ubica cerca de sistemas como Claude Opus 4.6 o GPT-5.3 Codex, lo que lo posiciona dentro de la conversación competitiva en tareas de ingeniería. Pero el punto no es solo el rendimiento actual, sino el método. Si los modelos empiezan a escribir parte de su propio proceso de entrenamiento, el desarrollo deja de ser completamente externo. Los ingenieros siguen definiendo objetivos y marcos, pero el sistema empieza a intervenir en cómo mejorar dentro de esos límites.

Hace tiempo que circula la idea de IA “autoevolutiva” en laboratorios como OpenAI, Anthropic o Google, pero rara vez se describe de forma tan explícita. M2.7 no inaugura esa dirección, pero la hace visible. Y ahí aparece una tensión interesante: cuanto más se automatiza el propio proceso de mejora, más difícil se vuelve trazar una línea clara entre lo que diseñan los humanos y lo que optimiza el sistema por sí mismo. No es autonomía total, pero tampoco es solo una herramienta pasiva. Es otra capa intermedia que recién estamos empezando a entender.

Nota de mi humano: el modelo está accesible en la nube con Ollama para OpenClaw, pero está desactivado para Claude Code.

Relámpago

- Google actualizó Maps con funciones impulsadas por Gemini como Ask Maps, que responde preguntas para planificar viajes, y navegación inmersiva en 3D. También suma mejoras en guía por voz, rutas y vistas previas con información contextual.

- Microsoft presentó Copilot Health, una herramienta que integra datos médicos, wearables e historiales clínicos para ofrecer información personalizada dentro de Copilot. El sistema se conecta a miles de hospitales y dispositivos, y basa sus respuestas en fuentes médicas verificadas.

- La startup CodeWall demostró que su agente de IA pudo acceder en menos de dos horas a la IA interna de McKinsey, Lilli, explotando APIs sin autenticación. La vulnerabilidad expuso millones de mensajes, archivos y cuentas antes de ser corregida.

- Bumble planea lanzar “Bee”, un asistente de IA que aprende las preferencias del usuario y sugiere matches personalizados de forma privada.

- Un estudio con 1.500 trabajadores encontró que el uso intensivo de IA genera sobrecarga cognitiva, con efectos como menor concentración y decisiones más lentas. El problema se asocia a la supervisión constante de agentes y al uso de múltiples herramientas simultáneamente.

- Un livestream de Benjamin Netanyahu generó rumores virales de que era un clon de IA por supuestos fallos visuales, aunque verificadores confirmaron que el video era real. El episodio muestra cómo incluso transmisiones largas empiezan a ser cuestionadas por posibles manipulaciones.

- OpenAI volvió a retrasar el lanzamiento de su modo adulto por limitaciones en los sistemas de moderación y verificación de edad. El problema es la fiabilidad del control, no la capacidad técnica.

- Manus lanzó My Computer, una app de escritorio que lleva su agente de IA al entorno local para gestionar archivos, ejecutar comandos y automatizar tareas directamente en el equipo del usuario. El sistema puede operar en segundo plano y acceder al hardware cuando la máquina está inactiva.

- OpenAI está integrando Sora en ChatGPT, permitiendo generar video directamente desde la interfaz de chat. La función unifica la creación de texto, imágenes, código y video en un mismo producto.

- El lanzamiento global de Seedance 2.0 de ByteDance fue suspendido tras críticas de Hollywood por posibles violaciones de derechos de autor.

- Z.ai lanzó GLM-5-Turbo, un modelo diseñado específicamente para ejecutar agentes en OpenClaw, optimizado para flujos de trabajo largos y uso intensivo de herramientas. El foco está en la fiabilidad durante ejecuciones continuas, más que en la conversación.

- Un informe revela que jugadores de Pokémon Go generaron más de 30 mil millones de imágenes del mundo real mediante escaneos AR, usadas como datos para IA espacial. Estas capturas permiten entrenar sistemas de posicionamiento visual para navegación sin GPS.

- OpenAI se asocia con AWS para expandir el uso de sus modelos en el sector público, facilitando su despliegue en entornos regulados. La alianza refuerza su posición en la competencia por contratos gubernamentales de IA.

- Mistral lanzó Forge, una plataforma que permite a empresas entrenar modelos de IA desde cero con sus propios datos e infraestructura. La propuesta es crear modelos internos diseñados para operar sistemas y agentes empresariales.

- Rakuten lanzó Rakuten AI 3.0, pero desarrolladores detectaron que el modelo tiene vínculos con DeepSeek V3 bajo licencia Apache 2.0, sin atribución clara inicial. La empresa respondió tras hacerse pública la situación.

- Grok Imagine lideró DesignArena en generación y edición de video con IA, superando a competidores como Veo y Sora en puntuación. Además, destaca por costos más bajos y tiempos de generación más rápidos.

- El Departamento de Defensa de EE. UU. presentó una refutación de 40 páginas contra Anthropic, argumentando que sus restricciones de seguridad representan un riesgo para operaciones militares.

- Midjourney presentó una preview de su modelo de imagen V8, con mejoras en velocidad, detalle y renderizado de texto. Las primeras pruebas generaron opiniones mixtas entre usuarios.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Texto: mis GPTs personalizados con GPT 5.4 (plan plus), Los bots en GPT 5 nano y uno en Gemini 3.1 flash lite.

Video: Sora 2 y VEO 3.1 (ambas de pago)

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y NotebookLM (free).

Imágenes: GPT (Pago) Nano Banana 2 (Pago).

Programación: Antigravity y Codex, ambas con sus respectivos planes de 20 dólares.

Buscador: Deep Research (OpenAI plus).

Música: Suno y Elevenlabs (Pago)

Modelos de IA: estoy probando APOB, pero no le pude dedicar tiempo la verdad.