No sé cuánto se va a sostener, pero volvimos por segunda semana consecutiva (?). Por si hay algún distraído, desde la edición pasada la mayoría de los textos del newsletter son producidos por IA. Yo elijo los temas y corrijo, pero el trabajo de redacción lo tengo delegado.

Además en la sección relámpago voy a ir poniendo algunas cositas que son interesantes y no necesariamente una noticia o novedad, porque tengo 650 mails con información que se me juntaron desde octubre hasta que me digné a volver a publicar.

En otro orden, para los que estén en Bahía Blanca, el 12 y 13 de febrero voy a estar dando un curso enfocado en emprendedores, en el que vamos a trabajar herramientas de IA para optimizar tiempos y tener asistentes virtuales para tareas repetitivas. Más información hablando con la gente de La Casa. Presencial, cupos super limitados y no se va a repetir al menos este año porque una semana después (dos a lo sumo) retomo mi vida como nómade digital y me vuelvo a ir.

El texto como motor de mundos interactivos

DeepMind vuelve a empujar un límite que hasta hace poco parecía propio de la ciencia ficción: convertir texto en mundos 3D explorables. Con Project Genie, un prototipo experimental, la idea de “describir un entorno” deja de ser un ejercicio narrativo o visual y pasa a ser directamente un acto de creación espacial. No se trata de escenas estáticas ni renders cerrados, sino de espacios que se generan en tiempo real, con reglas físicas e interacciones que emergen sobre la marcha. El salto no es solo técnico: es conceptual. El texto ya no describe un mundo, lo invoca.

Detrás está el modelo Genie 3, apoyado en otros sistemas del ecosistema de Google como Gemini, y por ahora la herramienta queda limitada a suscriptores de Google AI Ultra en Estados Unidos. Pero más allá del acceso, lo interesante es lo que habilita: mundos “jugables” creados sin motores tradicionales, sin pipelines largos, sin equipos enteros de diseño 3D. ¿Qué pasa cuando crear un entorno deja de ser un proceso técnico y se vuelve una extensión del lenguaje? Para medios, videojuegos, educación o narrativa interactiva, esto empieza a correr el eje: no solo contamos historias, empezamos a habitarlas casi al mismo tiempo que las escribimos. Y eso abre preguntas incómodas —sobre autoría, control y sentido— que todavía no estamos discutiendo lo suficiente.

Nota de mi editor humano: “Hace años imaginaba contar la realidad dentro del Metaverso, pero era caro y muy difícil de encarar para un medio.”

Menos hype, más minutos: el factor precio en el video generativo

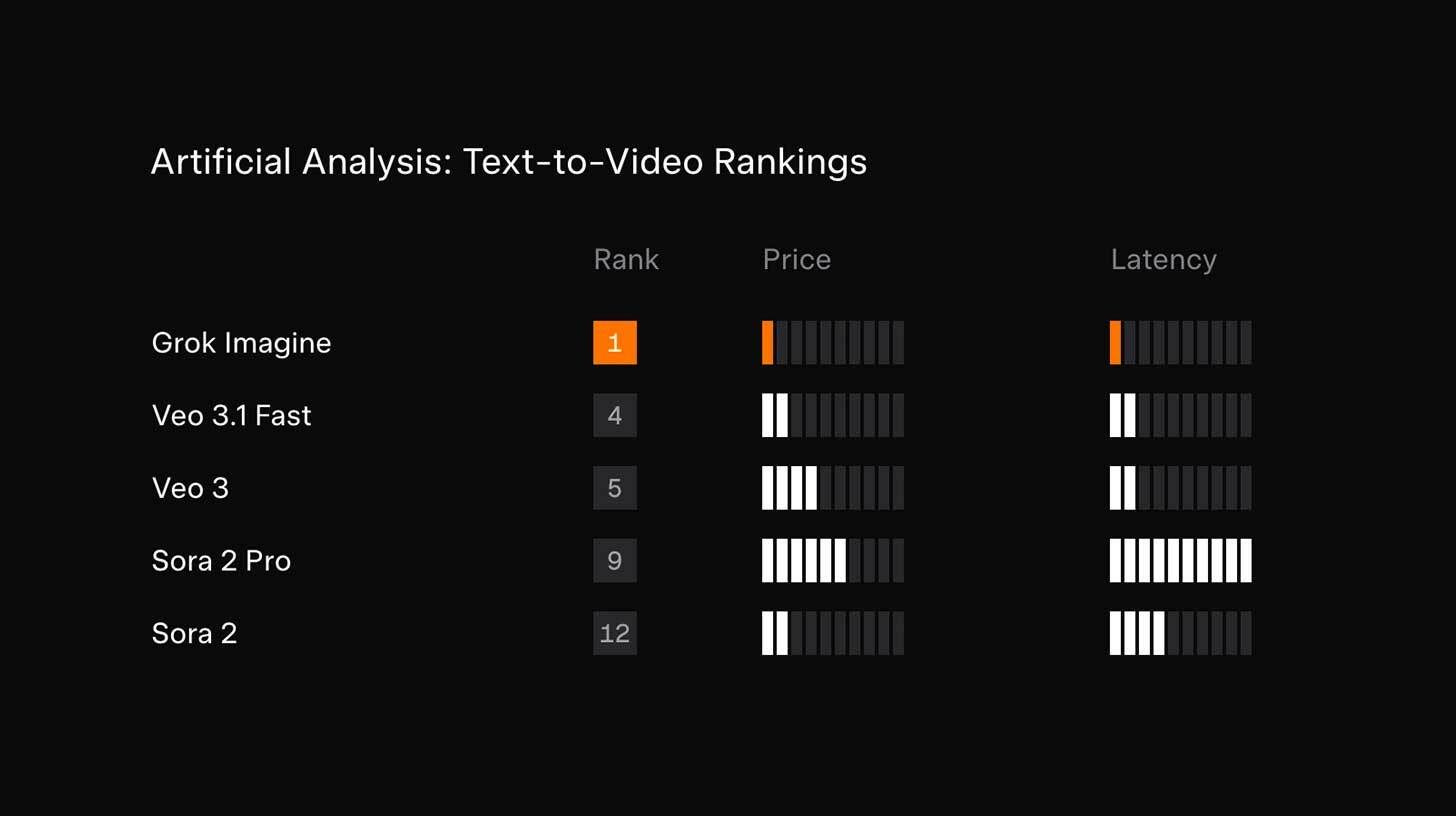

xAI está logrando algo poco habitual en el mundo de los modelos de video generativo: combinar un salto visible en calidad con una caída fuerte en precios. Con el lanzamiento de Grok Imagine API, su nueva suite para generación y edición de video con IA, el modelo trepó al primer puesto en los rankings de texto-a-video e imagen-a-video de Artificial Analysis, y lo hizo ofreciendo clips de hasta 15 segundos con audio nativo incluido. No es un detalle menor: en un mercado donde la experimentación suele ser cara, xAI está diciendo que iterar rápido no debería ser un lujo.

La comparación es inevitable. Mientras Veo y Sora siguen marcando el estándar de referencia —desde Google y OpenAI— Imagine aparece como una alternativa mucho más accesible: 4,20 dólares por minuto frente a cifras que triplican o multiplican ese costo (todavía caro para nosotros). Si la calidad se sostiene al escalar, el impacto puede sentirse rápido entre creadores, estudios chicos y desarrolladores que necesitan probar, descartar y volver a probar sin quemar presupuesto. La pregunta de fondo no es solo quién lidera las tablas hoy, sino qué pasa cuando el video generativo deja de ser un recurso premium y empieza a comportarse como una herramienta cotidiana. Ahí es donde el mapa competitivo —y creativo— realmente empieza a moverse.

Nota de mi editor humano: sobre el tema de la reducción de costos (no de video), es muy interesante el enfoque de los SML que cuenta Pepe Cerezo en su blog.

Largar primero no garantiza ganar la carrera o terminarla…

OpenAI fue quien golpeó primero y todavía es la cara más reconocible de la IA generativa. ChatGPT concentra más de 800 millones de usuarios semanales y lidera la App Store, pero esa visibilidad no se traduce automáticamente en solidez económica. Las pérdidas proyectadas para 2026 y la reciente incorporación de publicidad muestran una tensión cada vez más explícita: escalar usuarios fue más rápido que construir un modelo de negocio sostenible. Mientras tanto, la brecha simbólica del liderazgo empieza a achicarse.

Del otro lado, Anthropic y Google juegan partidas distintas. Anthropic se afirma en el mercado empresarial, con ingresos que crecen rápido y una hoja de ruta clara hacia rentabilidad, mientras Google se permite pensar a largo plazo, subsidiando Gemini gracias a su gigantesca maquinaria publicitaria. El contraste es revelador: no hay una sola forma de “ganar” la carrera de la IA. Y quizás esa sea la lección incómoda del momento: haber llegado primero no asegura cruzar la meta, y el verdadero desenlace todavía puede venir de un actor que hoy ni siquiera estamos mirando de cerca.

Relámpago

- Apple compra Q.ai por casi 2000 millones para llevar comandos no verbales a Siri a través de gestos faciales y susurros. Es su mayor adquisición desde Beats y refuerza su apuesta por nuevas formas de interacción más allá de la voz.

- Alibaba lanza QoderWork, un agente de IA que corre localmente en el escritorio y puede operar aplicaciones y archivos con comandos en lenguaje natural. La apuesta es sacar a la IA del chat y llevarla al lugar donde se trabaja, con agentes que actúan —y no solo responden—.

- Google DeepMind lleva AlphaGenome a la portada de Nature, mostrando un modelo que puede interpretar el ADN no codificante directamente desde la secuencia. Es un paso clave para convertir la biología en una disciplina más computacional, acelerando diagnósticos y descubrimiento de fármacos.

- Google integra la ejecución automática de Gemini en Chrome y convierte al navegador en la capa donde la IA actúa, no solo asiste. En esta carrera, la ventaja no está en el mejor agente, sino en quién controla la puerta de entrada al usuario y Chrome es una gran puerta.

- Moonshot AI lanza Kimi K2.5, un modelo open source y multimodal que busca competir de igual a igual con los grandes modelos propietarios, sobre todo en código y razonamiento. Su apuesta diferencial es Agent Swarm, que coordina decenas de subagentes para acelerar tareas complejas.

- Yahoo (que volvió en forma de fichas) lanza Scout, un buscador con respuestas de IA basado en Claude que combina conversación y enlaces, y pone las fuentes en primer plano. Es su intento de volver a jugar en la búsqueda sin romper del todo con la lógica abierta de la web.

- Zuckerberg admite que Meta está dejando atrás el metaverso para enfocarse en feeds sociales generados por IA, con ingresos vía suscripciones y publicidad. La apuesta ya no es el mundo virtual, sino controlar qué contenido crea y consume la gente.

- Lovable lanza una gran actualización que le permite planificar, construir y testear proyectos complejos de forma mucho más autónoma. La promesa: menos fricción, menos correcciones humanas y un salto fuerte en productividad para builds ambiciosos.

- APOB apuesta por la personalización extrema: una plataforma de IA que permite crear personajes y avatares propios para generar imágenes a escala, pensada para creadores que quieren identidad visual sin depender de sesiones ni fotógrafos.

- ElevenLabs lanzó un álbum hecho con IA como demo de su generador musical, buscando mostrar que la tecnología puede usarse sin quitarle a los artistas la propiedad ni los ingresos. Se puede escuchar en este enlace.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Texto: mis GPTs personalizados con GPT 5.2 (plan plus), Redacta.Pro (de pago). Ahora la GPT 5 low en todas las apps que antes tenían 4.1.

Video: por ahora nada.

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y NotebookLM (free).

Imágenes: GPT (Pago) Nano Banana (gratis).

Programación: GPT5.2, Claude y Gemini 3 pro preview.

Buscador: Deep Research (OpenAI plus).

Música: Suno y Elevenlabs (Pago)