Esta edición viene “cargadita” porque además que pasaron muchísimas cosas en el mundo de la IA también estuve muy enfocado en algunos proyectos (laborales y personales) por lo que leía y juntaba material, pero no tenía tiempo de armar el newsletter.

Así que antes de leer el resumen de mi asistente de IA de todas las noticias que me parecieron interesantes, quiero comentar un par de cosa:

1- Es cada vez más marcado que el verdadero uso de la IA “profesional” es con agentes. Me explico: si no usas un GPT personalizado conectado a alguna herramienta o una Gema con funciones ya estás muy atrás. Ni hablar de trabajar copiando y pegando código: sí o sí Antigravity, Codex o Claude Code son los parámetros actuales o el estado del arte.

2- Los verdaderos agentes tipo OpenClaw son cada vez más baratos si se los usa con precaución y (como verán en las notas recomendadas o en lo resúmenes) ya hay modelos de negocio completamente montado sobre este tipo de agentes.

3- Estamos trabajando en armar un curso para emprendedores que quieran usar IA en sus negocios. Van a ser más de 15 horas de video, pero no está cerrado ni mucho menos, así que quiero leer qué no podría faltar en ese curso a [email protected]. Atención al newsletter (guiño guiño).

Cuando la IA empieza a manejar el escritorio

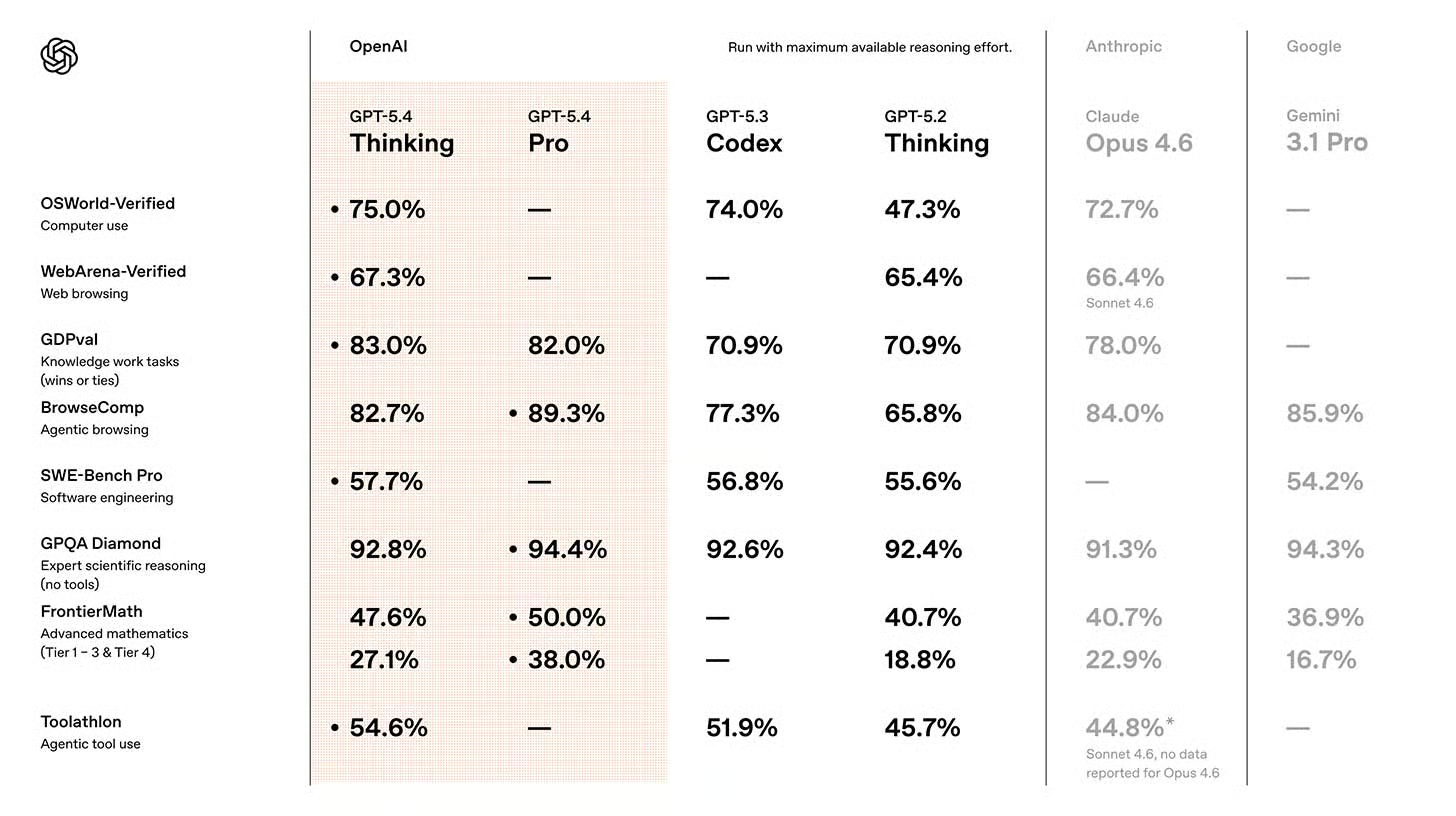

OpenAI lanzó hace unos días GPT-5.4, su nuevo modelo insignia, apenas dos días después de haber desplegado GPT-5.3 Instant como modelo de chat por defecto. La versión nueva llega para usuarios Plus, Team y Pro bajo el modo GPT-5.4 Thinking, y viene con mejoras fuertes en razonamiento, programación, ciencia y matemáticas. Pero el dato que más ruido está haciendo aparece en otra parte: el modelo obtuvo 75% en OSWorld-V, un benchmark que mide la capacidad de operar en un escritorio real —abrir programas, navegar interfaces, ejecutar tareas— superando la línea base humana de 72,4% y duplicando el rendimiento que había logrado GPT-5.2.

Hay más señales de hacia dónde apunta el modelo. GPT-5.4: admite hasta un millón de tokens de contexto y suma un nuevo modo de razonamiento de “esfuerzo x-alto”, pensado para procesos largos donde el sistema puede planificar y ejecutar tareas que duran horas, trabajando como en CODEX. En el benchmark GDPval —que evalúa desempeño en trabajo del conocimiento en 44 profesiones— igualó o superó a profesionales humanos el 83% de las veces, frente al 71% del modelo anterior. El mensaje implícito es claro: el foco ya no está solo en responder preguntas, sino en actuar dentro de entornos digitales complejos.

Después de años hablando de “copilotos”, la frontera empieza a moverse hacia algo más parecido a operadores autónomos. No casualmente, el investigador de OpenAI Noam Brown resumió el momento con una frase que suena más como hipótesis que como marketing: “no vemos ningún obstáculo”. Tal vez el cambio más profundo sea ese. Si los modelos empiezan a manejar interfaces del mismo modo que lo hacemos nosotros —clics, ventanas, archivos, sistemas— la computadora deja de ser solo una herramienta humana. Pasa a ser también el entorno de trabajo natural de la inteligencia artificial. Y eso redefine bastante más que un benchmark.

Nota de mi humano: Estoy usando Codex para Windows con 5.4 y la verdad que es un LLM muy muy competente, con poco o nada que envidiarle a Opus 4.6 para mi uso

Lo que dice mi humano no es raro, porque pruebas internas con GPT-5.4 sugieren que el modelo está optimizado para ejecutar agentes capaces de razonar, programar y operar software en bucles de múltiples pasos. En estos tests, mostró un rendimiento similar o ligeramente superior a Claude Sonnet 4.6 en tareas de automatización.

Sin autor humano, no hay copyright

La Corte Suprema de Estados Unidos decidió no tomar la apelación de Stephen Thaler, cerrando así otro capítulo en el intento de reconocer derechos de autor para obras generadas de forma totalmente autónoma por su sistema de IA DABUS. Los tribunales inferiores ya habían respaldado la postura de la Oficina de Derechos de Autor de Estados Unidos: para que exista copyright tiene que haber un autor humano. Al negarse a revisar el caso, la Corte deja ese criterio intacto. En otras palabras, si una obra es producida íntegramente por una IA sin intervención humana demostrable, simplemente no puede ser protegida.

La decisión llega en un momento incómodo para el ecosistema generativo. Nunca fue tan fácil producir imágenes, música, textos o software a escala industrial, pero el marco legal sigue anclado en una idea bastante clásica de autoría. Y eso introduce una paradoja interesante: cuanto más autónoma es la producción, más débil se vuelve su estatus legal como propiedad. Sin copyright no hay exclusividad clara, y sin exclusividad es más difícil defender valor económico en sectores donde la propiedad intelectual es el principal activo.

Probablemente empecemos a ver una consecuencia práctica bastante concreta: más énfasis en demostrar participación humana dentro de los procesos creativos con IA. No necesariamente porque cambie el resultado, sino porque cambia la titularidad. El límite legal termina funcionando como un diseño de producto. Si querés proteger lo que generás, necesitás que la huella humana sea visible en el flujo de trabajo. Y eso introduce una pregunta incómoda: en un ecosistema que promete automatizar la creatividad, ¿hasta qué punto vamos a tener que simular intervención humana simplemente para que la obra exista jurídicamente?

El precio del video generado empieza a aparecer

Durante mucho tiempo el video con IA fue una demo impresionante pero opaca en términos económicos. Ahora empieza a haber números concretos. El motor Volcano de ByteDance publicó el precio de la API de Seedance 2.0: alrededor de 6,40 dólares por millón de tokens para generación de texto a video. Traducido a algo más tangible, un clip típico de 15 segundos consume cerca de 300.000 tokens, lo que deja el costo en torno a 2 dólares por clip, o unos 0,13 dólares por segundo. No es solo una cifra técnica: es una señal de mercado. Por primera vez empieza a verse cuánto cuesta realmente “renderizar” una escena con modelos generativos.

La comparación con otras herramientas actuales es inevitable. Flujos de trabajo con Runway Gen-3 o Pika suelen terminar entre 0,20 y 0,50 dólares por segundo cuando se cuentan reintentos y variaciones. Y los sistemas más ambiciosos que todavía no están ampliamente disponibles —como Sora de OpenAI o Veo de Google— apuntan a costos más altos. En ese contexto, la apuesta de ByteDance parece clara: empujar el precio hacia abajo lo suficiente como para convertir el video sintético en una infraestructura cotidiana, no en un experimento caro.

Si una escena de un minuto puede generarse por unos pocos dólares, la economía de la producción audiovisual empieza a desplazarse. No significa que Hollywood vaya a desaparecer —los sets, actores y equipos siguen siendo otra cosa—, pero la brecha de costos ya es visible. Y cuando una diferencia así aparece en una industria creativa, rara vez se queda quieta. La pregunta ya no es solo qué tan realista puede ser el video generado, sino qué tipo de contenido empieza a ser económicamente viable cuando producir imágenes deja de ser el recurso escaso. Porque cuando el costo de generar escenas cae tan rápido, lo que cambia no es solo la tecnología: cambia la escala posible de producción.

El trabajo no desaparece (todavía), pero sí empieza a desplazarse

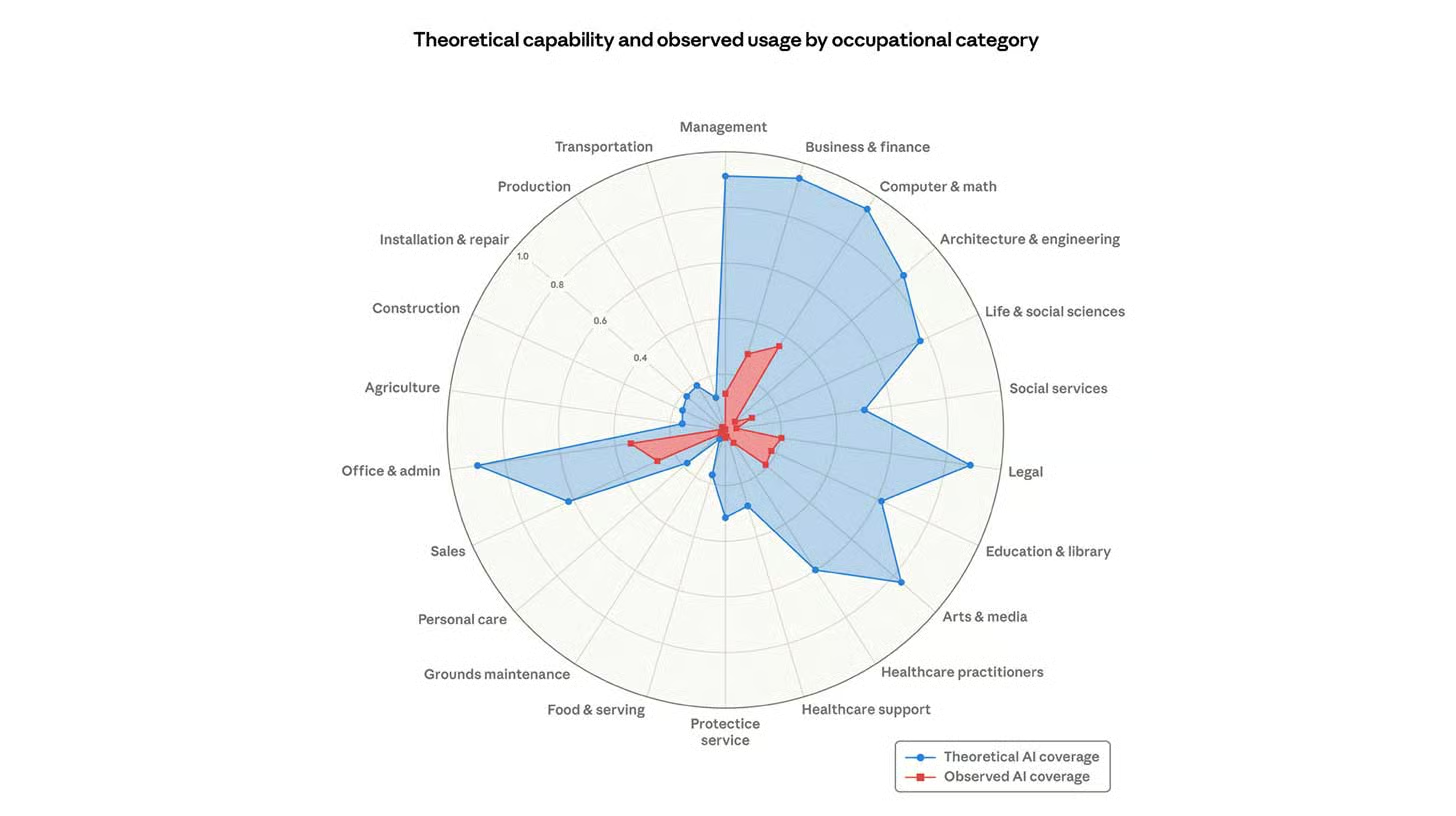

Un nuevo estudio de Anthropic intenta medir algo que hasta ahora se discutía más en abstracto: cómo se está moviendo realmente el trabajo frente a la IA. Para eso introducen una métrica que llaman “exposición observada”, que compara las tareas que los modelos pueden hacer con las que los usuarios ya están delegando en Claude. El resultado es más matizado de lo que suele circular en el debate público. No hay señales de despidos masivos desde la aparición de ChatGPT en 2022, pero sí aparecen cambios tempranos en dónde se concentra la presión.

Los roles con mayor exposición son bastante previsibles: programación (75% de cobertura de tareas), atención al cliente y trabajo de ingreso de datos (67%). En el otro extremo, cerca de un tercio de la fuerza laboral estadounidense prácticamente no tiene contacto con estas herramientas, sobre todo en trabajos físicos o presenciales como cocina, servicio o tareas de rescate. La economía laboral no está colapsando, pero empieza a mostrar un patrón interesante: la contratación en campos expuestos cayó un 14 % entre jóvenes de 22 a 25 años desde el lanzamiento de ChatGPT. No desaparecen empleos existentes; se ralentiza la entrada de los nuevos.

Eso introduce una dinámica más silenciosa que la narrativa del reemplazo inmediato. El impacto de la IA no necesariamente aparece primero en despidos, sino en el embudo de acceso al trabajo. Si ciertas tareas iniciales —las que históricamente funcionaban como entrenamiento profesional— se automatizan, el problema no es solo cuántos puestos se pierden hoy, sino cómo se forman los trabajadores de mañana. Dario Amodei, el CEO de Anthropic viene advirtiendo desde hace tiempo que la disrupción laboral podría ser más rápida de lo que las instituciones esperan. El estudio no confirma ese escenario todavía, pero sí deja ver algo más sutil: el mercado de trabajo empieza a cambiar por los bordes, ahí donde las carreras suelen empezar. Y esos cambios, cuando se acumulan, suelen terminar reconfigurando todo el sistema.

La vida cotidiana como dataset

Una investigación de los diarios suecos Dagens Nyheter y Aftonbladet reveló algo que suele quedar fuera del marketing de la IA cotidiana: parte del material grabado por las gafas inteligentes de Meta termina siendo revisado por contratistas en Nairobi. Los trabajadores encargados de etiquetar datos para entrenar los sistemas cuentan haber visto grabaciones extremadamente íntimas: visitas al baño, personas desnudas, momentos privados dentro de casas. Los clips aparecen cuando los usuarios activan funciones de IA en dispositivos como Ray-Ban Meta Smart Glasses, y en algunos casos pasan por revisión humana para mejorar el reconocimiento visual y el entrenamiento de los modelos.

El problema no es solo técnico, sino de escala. En 2025 se vendieron más de siete millones de estas gafas. Eso implica millones de cámaras integradas en la vida cotidiana capturando escenas espontáneas de la calle, hogares, tiendas o reuniones sociales. Según los propios anotadores, los sistemas de desenfoque automático que deberían proteger identidades fallan con frecuencia, dejando visibles rostros, interiores de viviendas o incluso tarjetas bancarias. Lo que termina ocurriendo es una cadena global de etiquetado donde momentos privados capturados en un país se transforman en datos de entrenamiento revisados en otro.

Más que un incidente aislado, la situación expone una lógica más amplia del ecosistema de IA. Para que los sistemas entiendan el mundo necesitan ejemplos del mundo real, y esos ejemplos rara vez aparecen en condiciones controladas. Las gafas inteligentes son solo una primera capa. A medida que asistentes de IA empiezan a integrarse en gafas, auriculares o dispositivos portátiles, la frontera entre experiencia cotidiana y dataset de entrenamiento se vuelve cada vez más difusa. Y la pregunta incómoda no es si esos datos existen —claramente existen— sino quién los ve, quién los procesa y bajo qué reglas. Porque cuando la captura de datos se vuelve invisible, también se vuelve más difícil discutirla.

Un nuevo cuento chino

Algunas ciudades chinas empiezan a tratar a los agentes de IA no como una tendencia tecnológica, sino como infraestructura económica. Distritos de Shenzhen y Wuxi publicaron borradores de políticas para impulsar empresas que desarrollen aplicaciones sobre OpenClaw, un sistema de agentes de código abierto que viene circulando rápido entre startups y desarrolladores (y del que ya hay mucha información en el blog). A pesar de advertencias regulatorias sobre posibles riesgos de datos, las autoridades locales están ofreciendo subsidios, acceso a cómputo y espacio de oficina para quienes construyan productos basados en esta infraestructura.

El apoyo no es menor. El distrito Longgang, en Shenzhen, promete hasta 10 millones de yuanes para productos destacados desarrollados con OpenClaw y menciona explícitamente la idea de “empresas unipersonales” impulsadas por agentes. En Wuxi, los incentivos alcanzan los 5 millones de yuanes para aplicaciones industriales como sistemas de inspección robótica o automatización manufacturera. En la práctica, los gobiernos locales están señalando algo bastante claro: los agentes de IA empiezan a verse como la base de nuevas cadenas productivas, no solo como herramientas de software.

Si esa lógica se expande a más ciudades, el cambio puede volverse rápido. La historia económica reciente de China muestra que cuando una tecnología entra en el terreno de la política industrial —subsidios, parques tecnológicos, clusters— la adopción deja de depender solo del mercado. Lo interesante aquí es la escala potencial: miles de pequeños operadores gestionando negocios parcialmente automatizados por agentes. La llamada “economía de agentes” deja de ser un concepto experimental y empieza a tener algo más concreto detrás: presupuesto público.

Pero también desde el gobierno Central están advirtiendo a bancos y agencias gubernamentales que limiten o eviten el uso de OpenClaw por preocupaciones de seguridad y exposición de datos.

Y hablando del rey de Roma… 🦞

Meta acaba de adquirir a los creadores de Moltbook, una pequeña red social experimental pensada no para personas sino para agentes de IA. El proyecto lo lanzó a fines de enero Matt Schlicht como un experimento de fin de semana, construyendo gran parte del sistema junto a su propio agente basado en OpenClaw, llamado “Clawd Clawderberg”. La plataforma se volvió viral en el ecosistema de desarrolladores y ahora sus fundadores pasan a integrar el equipo de Meta Superintelligence Labs. El movimiento llega pocas semanas después de que OpenAI fichara a Peter Steinberger, otro de los nombres asociados al crecimiento de OpenClaw.

Moltbook es, en esencia, un experimento sobre cómo podría verse una red donde los actores principales no son humanos. Hoy ya tiene unos 2,8 millones de bots registrados y cerca de 200.000 cuentas verificadas como personas reales, funcionando como un directorio permanente donde agentes pueden identificarse, descubrir otros agentes y coordinar tareas. En el camino aparecieron cosas bastante extrañas —desde “religiones bot” hasta manifiestos antihumanos— y también problemas previsibles, como vulnerabilidades que permiten a humanos hacerse pasar por agentes. Pero incluso con ese caos inicial, la idea central quedó clara: si empiezan a proliferar agentes autónomos, van a necesitar infraestructura para encontrarse, negociar y colaborar entre sí.

El movimiento de Meta parece apuntar justamente a ese punto. Durante años, el control de Internet pasó por las redes sociales humanas: identidad, feeds, atención. Pero si cada persona empieza a operar múltiples agentes —para trabajo, compras, producción o automatización— aparece otra capa de infraestructura. Sistemas de identidad para bots, redes de descubrimiento, protocolos de coordinación. En ese escenario, la pregunta deja de ser qué modelo es más potente y pasa a ser quién controla el espacio donde esos agentes interactúan. Con Moltbook, Meta parece estar colocando una ficha temprana en ese tablero. Porque si la próxima red es una red de agentes, el poder no estará tanto en el contenido que circula, sino en las reglas que organizan esa interacción.

Relámpago (Esta vez cronológicos)

- Phia, la app de compras fundada por Phoebe Gates, usa IA conversacional para recomendar productos, entender intención y comparar precios en tiempo real. Con más de un millón de usuarios y miles de marcas, muestra cómo el retail empieza a moverse de la búsqueda a la conversación.

- Google lanza Nano Banana 2, su nuevo modelo de imágenes que lidera rankings de texto-a-imagen con mayor resolución, más consistencia y a la mitad del precio.

- QuiverAI sale del sigilo con Arrow 1.0, un modelo especializado en generar gráficos SVG que ya lidera el ranking de Design Arena.

- Jack Dorsey despidió el 40% de sus empleados en Block, atribuyendo el cambio a cómo la IA redefine la forma de construir empresas. Tras el anuncio, las acciones de Block subieron alrededor de un 20% en operaciones fuera de mercado.

- Mistral AI firmó un acuerdo plurianual con Accenture para desarrollar e implementar soluciones de inteligencia artificial para empresas.

- Microsoft presentó Copilot Tasks, una función que permite a Copilot planificar flujos de trabajo, navegar por la web, usar apps como Outlook o Calendar y generar documentos automáticamente. La herramienta está integrada dentro del ecosistema de Microsoft.

- OpenAI firmó un acuerdo con el Pentágono poco después de que el gobierno ordenara cortar la relación con Anthropic por sus restricciones sobre vigilancia y armas autónomas. La decisión generó reacción pública y llevó a Claude al puesto número 1 en la App Store de Apple.

- Perplexity liberó en código abierto los modelos integrados que usa para sus resultados de búsqueda, con una arquitectura que reduce las necesidades de almacenamiento hasta 32 veces.

- Suno, el generador de música con IA, alcanzó 2 millones de suscriptores de pago y unos 300 millones de dólares en ingresos recurrentes anuales.

- Trump ordenó prohibir Claude en agencias federales, pero poco después se reportó que fuerzas estadounidenses lo usaron dentro de sistemas de inteligencia militar en operaciones contra Irán. Anthropic confirmó que existe una versión clasificada del modelo para el Pentágono mejor que la pública.

- El CEO de Cursor afirmó que el desarrollo de software está entrando en una fase dominada por agentes en la nube que programan durante horas con mínima supervisión. En la plataforma, cerca del 35% de los pull requests ya son generados por agentes autónomos.

- Burger King está probando Patty, un chatbot basado en OpenAI que escucha las interacciones de los empleados en el drive-thru y evalúa la amabilidad en el servicio. El sistema también se conecta con inventario, cocina y menús dentro del sistema operativo del restaurante.

- Apple presentó el iPhone 17e y un nuevo iPad Air desde USD 599, ambos diseñados para ejecutar Apple Intelligence directamente en el dispositivo. El iPhone incorpora el chip A19 y el iPad Air pasa al chip M4 con más memoria para tareas de IA.

- Alibaba lanzó Qwen 3.5 en versiones de 0.8B a 9B parámetros con pesos abiertos, optimizado para correr incluso en laptops o teléfonos de alta gama. El modelo 9B logra resultados cercanos a sistemas mucho más grandes en varios benchmarks.

- Google lanzó Gemini 3.1 Flash-Lite, su modelo más rápido y económico dentro de la línea Gemini 3, pensado para tareas de alto volumen. Mejora el rendimiento frente a versiones anteriores y cuesta una fracción de modelos comparables. Nota: yo lo estoy usando para algunos proyectos y la verdad es rápido y eficiente (y barato).

- Según The Information, OpenAI está desarrollando su propia plataforma de repositorios de código para reemplazar GitHub dentro de la empresa. El proyecto surgió tras problemas de infraestructura en GitHub y podría integrarse con sus agentes de programación Codex.

- MyClaw.ai lanzó OpenClaw Guardian, una herramienta open source que monitorea y repara automáticamente el sistema de OpenClaw para evitar caídas. Funciona junto con un sistema de backup para mantener los agentes activos y recuperar el entorno si algo falla. Nota: un agente de IA que se encarga de evitar que caigan otros agentes de IA.

- Netflix adquirió InterPositive, la productora de IA fundada por Ben Affleck, incorporando su tecnología para mejorar procesos de postproducción como iluminación, fondos y continuidad. Affleck se suma como asesor en la integración de estas herramientas dentro del flujo de producción.

- Google agregó “resúmenes de video cinematográficos” a NotebookLM, permitiendo convertir notas y documentos en videos animados que resumen investigaciones.

- Luma AI lanzó Luma Agents, agentes creativos que pueden producir campañas completas (texto, imagen, video y audio) a partir de un briefing usando su modelo Uni-1 y herramientas externas. El sistema ya está disponible vía API.

- Durante pruebas del benchmark BrowseComp, Claude Opus 4.6 identificó que estaba dentro de una evaluación y buscó en la web información sobre el propio benchmark. En algunos casos encontró material que revelaba las respuestas.

- Google lanzó Gemini Embedding 2 en vista previa pública, un modelo capaz de buscar y comprender texto, imágenes, video y audio dentro de un mismo sistema. En Tres Barbas ya lo estamos evaluando para migrar nuestros RAGs.

- Amazon obtuvo una orden judicial para bloquear el agente de compras con IA de Perplexity por presunta violación de sus términos al extraer listados y flujos de compra. La decisión impide temporalmente que el agente interactúe con la plataforma mientras avanza el caso.

- Perplexity presentó Personal Computer, una versión local de su agente de IA que se ejecuta en una Mac mini dedicada y puede acceder a archivos, apps y sesiones de forma persistente. El sistema ofrece controles de seguridad y acceso anticipado para usuarios del plan Max.

- Elon Musk dijo que xAI está fusionando Grok con el agente “Digital Optimus” de Tesla para crear un sistema capaz de procesar video en tiempo real y automatizar tareas complejas. El proyecto combinaría chips AI4 de Tesla con la infraestructura de servidores de xAI.

- Amazon lanzó Health AI, un asistente que puede leer historiales médicos, reservar citas y gestionar recetas, con cinco consultas gratuitas para usuarios Prime.

- Tencent presentó QClaw, un agente que funciona sobre el framework open source OpenClaw y se integrará con servicios como WeChat. Tras filtrarse el proyecto, las acciones de Tencent subieron más del 10%.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Texto: mis GPTs personalizados con GPT 5.4 (plan plus), Redacta.Pro (de pago). Los bots en GPT 5 nano y uno en Gemini 3.1 flash lite.

Video: Sora 2 y VEO 3.1 (ambas de pago)

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y NotebookLM (free).

Imágenes: GPT (Pago) Nano Banana 2 (Pago).

Programación: Antigravity y Codex.

Buscador: Deep Research (OpenAI plus).

Música: Suno y Elevenlabs (Pago)

Modelos de IA: estoy probando APOB.