Cuando comienzo a armar el newsletter (por lo general cuando lanzo el anterior) me digo: “El próximo no va a ser sobre la carrera estilo armamentística de las empresas”, pero la realidad es que con esa carrera aparecen las “nuevas armas” que terminan siendo claves para nuestros propios proyectos.

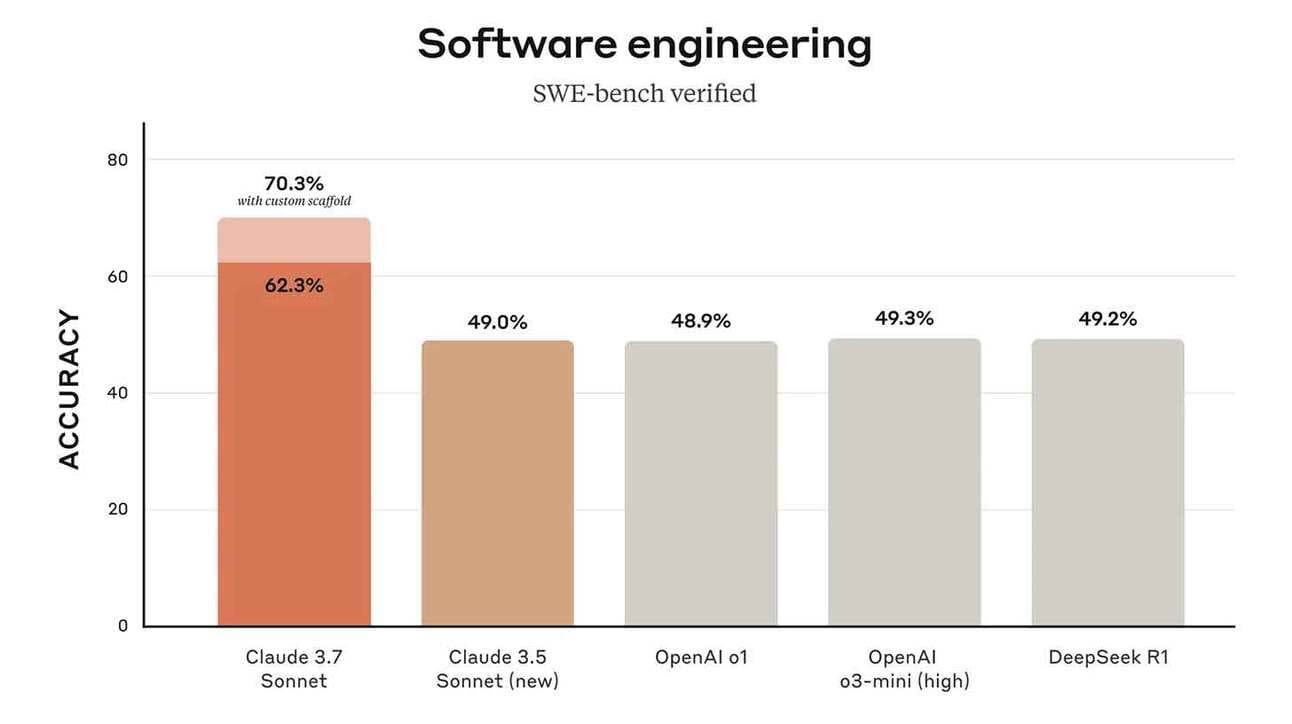

Y hoy le toca a Anthropic, que se decía iba a lanzar su modelo 4. Antes de seguir, para los que no están tan en tema, Anthropic es una empresa con un fuerte compromiso con la seguridad y unos modelos de IA muy robustos para programar. Ojo, muy prolijos para todo, pero con habilidades muy superiores en resolver problemas (clave para la programación).

Bueno, volviendo, no pasó; no lanzaron el esperado modelo 4 (que haga un salto de calidad cualitativo desde el 3 y el 3.5) sino que lanzaron el… 3.7.

Son así los primeros que lanzan el modo “híbrido” (que parece el modelo que seguirán todas las empresas eventualmente) y que consiste en decidir (el modelo) si conviene contestar de una o “pensar”. Además habilitaron el control de “pensamiento” en la API para desarrolladores, así que en las aplicaciones se va a poder determinar el tiempo exacto para dedicarle a las interacciones (tiempo y costo).

En el paquete de actualización también está Claude Code, un agente de programación que está en beta limitada, pero que según muestran en este video puede leer archivos para “entender proyectos” y luego ejecutar pruebas, cambios, optimizar, etc.

La lógica de los agentes es que puedan hacer una tarea por completo, en este caso programar, y para hacerlo deberían poder actuar como un programador que ve todos los archivos, los prueba y ejecuta y parece que lo hace bastante bastante bien (cosa que ellos saben que es así porque es su fortaleza).

Buscar en profundidad

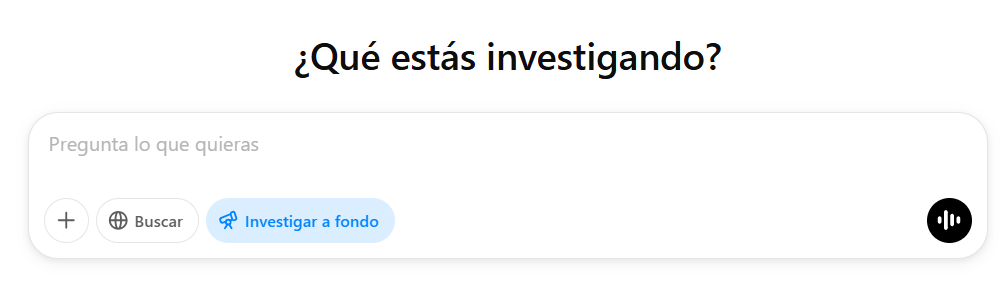

Los usuarios plus de OpenAI ya tenemos acceso a su modelo Deep research, que es el agente de búsqueda disponible hasta anoche solo para el plan PRO (el de 200 dolarucos).

Es el mismo modelo que hace casi un mes te conté que empezaba a justificar el costo de la suscripción PRO y que lo hacía más tentador porque da acceso al modelo o3 (no el mini que es el que podemos usar) y al agente que se dedica a investigar, entender y producir la información que le solicitemos.

Lo que sí, a usarla con responsabilidad, porque por el momento son solo 10 búsquedas profundas por mes, comparadas con las 120 de la versión PRO.

Voy a “investigarlo a fondo”´(cuack) y en las próximas entregas daré mis impresiones y mostraré si hay algún resultado que respalde desde lo terrenal todo el hype entorno a este tipo de búsquedas.

Lo que sí este tipo de tecnología me genera preguntas:

-¿Qué pasa con los sitios visitados para generar el informe?

-¿Qué pasa con los sitios que bloquean el acceso de los modelos?

Porque es un tema delicado: elegir entre proteger los derechos de la creación de contenidos o quedar fuera de ser fuente de investigación de trabajos cada vez más profesionales. No tengo una respuesta y creo que será algo que cada editor deberá pensar para su medio.

Más razonamiento y videos “gratis”

Por su parte, la gente de Alibaba sigue mejorando sus modelos de código abierto (prometidos en breve) y pensamiento de la familia QwQ, con el lanzamiento ayer de QwQ-Max-Preview que suma mejores capacidades de razonamiento profundo.

Prometen liberarlo con una licencia libre para desarrolladores, por lo que es otra posibilidad para sumarse a la carrera de servicios para pequeñas empresas sin capacidad de entrenar un modelo, pero sí con la posibilidad de dar servicios con ellos y poder ajustarlos a gusto o ejecutarlos en los servidores propios.

También lanzaron Wan2.1, un conjunto de modelos de generación de video de código abierto, que señalan supera a Sora (lo que a esta altura tampoco era tan difícil). Se pueden descargar y ejecutar en local, lo malo es que aunque sean “pequeños” están lejos de las computadoras de los simples mortales.

Es este el momento en el que, si no te lo preguntaste con la cantidad de veces que lo mencioné en estos correos, te preguntes: ¿Qué estás esperando para crear tu propio negocio o herramienta con IA?

Una pista

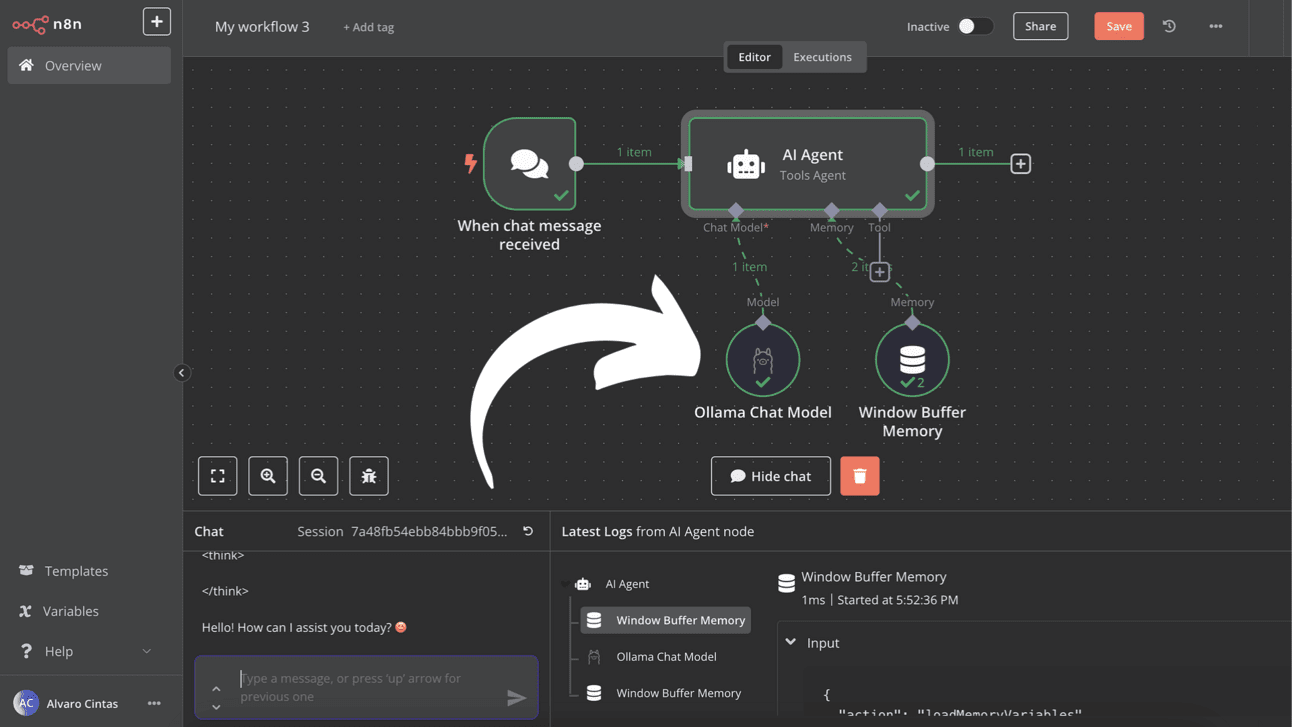

Ya que estamos en tema, con un par de tutoriales, un par de dólares (seguramente menos de 40) se pueden montar automatizaciones comerciales usando N8N (un automatizador que no necesita casi nada de código).

La idea de este tipo de herramientas es que armes diagramas de trabajo, por ejemplo para chatbots o publicaciones automáticas y usas algún modelo de IA privado como OpenAI o de código abierto como DeepSeek para solucionar problemas.

Porque esa es la clave, encontrar un punto de dolor en tu proceso productivo o en el de alguien más, generar una solución, probarla e implementarla y de paso ganar dinero.

Nosotros en Tres Barbas, por ejemplo, tenemos automatizaciones para alertas SEO, producción de reportes y asistencia a usuarios. O también nuestro propio asistente para redacciones que simplifica la creación del contenido más rutinario dando incluso los copys para cada red social.

Si alguno de estos posteos te inspira, te invito a que me lo cuentes y si querés compartamos opiniones al respecto.Mensaje M. S. Decker Díaz

¿Para qué hablar como humanos?

Películas, libros y series nos advierten sobre máquinas que aprenden a hablar entre ellas y deciden destruirnos… Bueno, ese fue el planteo de muchos medios los últimos días al conocerse este video:

Más allá que sería lo más lógico no usar lenguaje natural para que 2 IA se comuniquen por sonido, ese video es el resultado de la presentación del protocolo de comunicación Gibber Link.

La idea es que cuando estas interacciones ocurran se pueda recurrir a esta forma de comunicación, más rápida y por ende más barata (recuerden que buena parte del costo es una computadora prendida gastando electricidad y vida útil) por lo que la velocidad importa.

Según sus desarrolladores, Anton Pidkuiko y Boris Starkov, el proyecto que ganó el hackaton de ElevenLabs utiliza una biblioteca de datos sobre sonido de código abierto llamada “ggwave”. El uso del protocolo de nivel de sonido en lugar de generar voz reduce los costos de procesamiento hasta en un 90 % y acorta el tiempo de comunicación hasta en un 80 %.

Relámpagos

- Como no podía ser de otra manera, hubo lío con Grok 3 de xAI (de Elon Musk) luego de que usuarios descubrieran que se negaba a hablar de su dueño y de Donald Trump.

- ¿Cuánto por Robotina? La empresa noruega de robótica 1X acaba de lanzar NEO Gamma, un humanoide de próxima generación diseñado específicamente para entornos domésticos.

- Los investigadores de Hugging Face lanzaron SmolVLM2, la familia de modelos de IA más pequeña del mundo para comprender y analizar videos en dispositivos cotidianos como teléfonos y computadoras portátiles, sin requerir servidores potentes o conexiones en la nube.

- VEO 2, el modelo de video de Google, ya se puede usar en la versión de pago de la empresa española FreePik. Recordemos que el modelo es de lo mejorcito en video que hay en el mercado.

- DeepSeek indicó que planean abrir 5 nuevos repositorios de código que están “probados” en batalla. La empresa china ya superó los 20 millones de usuarios.

- Microsoft afirmó que su nuevo modelo de aprendizaje profundo de código abierto BioEmu-1 puede igualar a una supercomputadora con un solo chip a la hora de simular estructuras de proteínas.

- Nvidia y la Sociedad Americana para Niños Sordos presentaron la plataforma Signs que puede ayudar a las personas a aprender el lenguaje de signos americano.

- De Google también y en sintonía con lo de Claude: lanzaron una versión gratuita de Gemini Code Assist (una extensión de VSC) para desarrolladores individuales, que ofrece acceso a ayuda de codificación avanzada impulsada por IA.

Qué estoy usando

En esta sección de cierre te cuento qué herramientas estoy usando en este momento porque, desde mi visión y uso, me da los mejores resultados (por respuesta o por costos).

Es algo súper íntimo y pueden no estar de acuerdo, pero creo que es una manera interesante de no solo decir “existe esto” si no “yo lo uso así” (o no).

Texto: o1 y alguna cosita de o3 (plan plus), Redacta.Pro (de pago). Para aplicaciones 4o-mini y algunas con 4o.

Video: Runway (en el free y para cosas muy específicas).

Audio: Elevenlabs (Pago), Adobe Audition (Pago) y esta semana no estoy teniendo suerte con los podcasts personalizados con NotebookLM (free).

Imágenes: Dall-E 3 (Pago) y Adobe Photoshop (Pago), BlinkShot (gratis, pero limitada) e ImagenFX (con VPN de EEUU).

Programación: o3 mini (plan plus).

Buscador: En proceso Deep Research (OpenAI plus)

Música: Suno (cada día la amo más)

Miscelánea: Endless.

Este posteo se hizo originalmente en Substack, pero por cuestiones editoriales decidí migrar los contenidos a mi propia plataforma.