Cuando parecía que nos poníamos al día, va y Anthropic hace un par de anuncios de lo más interesantes.

En primer lugar mejoraron sus modelos, todavía no largan ese súper modelo tan esperado, pero sí mejoraron el “normal” (Sonnet) y el livianito ideal para aplicaciones de terceros. Ya se pueden probar y los resultados de las marcas de aprendizaje (digamos la comparación con otros modelos) le dieron muy bien.

Hay un tema acá, el modelo de Sonnet para tareas de programación siempre me resultó mejor que GPT 4o, así que esta mejora para mí es de lo más prometedora (más abajo vas a entender por qué).

Pero lo más interesante como concepto, lo cuenta en este posteo de X, es la liberación de su API que puede tomar control de una computadora. Sí, accede al sistema operativo y realiza operaciones. Está super en beta, comete varios errores (algunos divertidos) pero es una gran experiencia pasar de dialogar o ver código y corregirlo a que tome el control de un dispositivo e interactúe con el mismo.

Hay que ver qué dice la comunidad de desarrolladores, qué problemas o ideas nacen de la interacción, pero cualquier resultado (positivo o negativo) sirve para el crecimiento de la IA en el uso cotidiano. Además, nos acerca a un dispositivo solo con IA sin ningún tipo de sistema operativo o aplicaciones, lo que claramente sería más eficiente en tiempos y recursos energéticos.

Creando una App sin programar

Nótese que puse sin programar y no “sin saber programar” porque siempre hay que toquetear algo o hacer algún tipo de configuración, ya que si no sabes nada ni O1 te la resuelve (?)

Pero hoy voy a hablar de cómo montar una aplicación que sirva para hacer un MVP o prototipo y validar una idea, solo escribiendo un poco y usando inicialmente 2 aplicaciones gratuitas de IA.

La primera es Llama Coder, una app que como imaginaran corre con Llama, en su versión 3.1 (ya salió la 3.2) y con 405 mil millones de parámetros (o sea el modelo grande).

Uno escribe la idea de aplicación que tiene en mente y la desarrolla en React, lista para descargar y ejecutar en un servidor propio o en la versión gratuita que te brinda esta aplicación open sourse. Su creador tiene un perfil muy interesante.

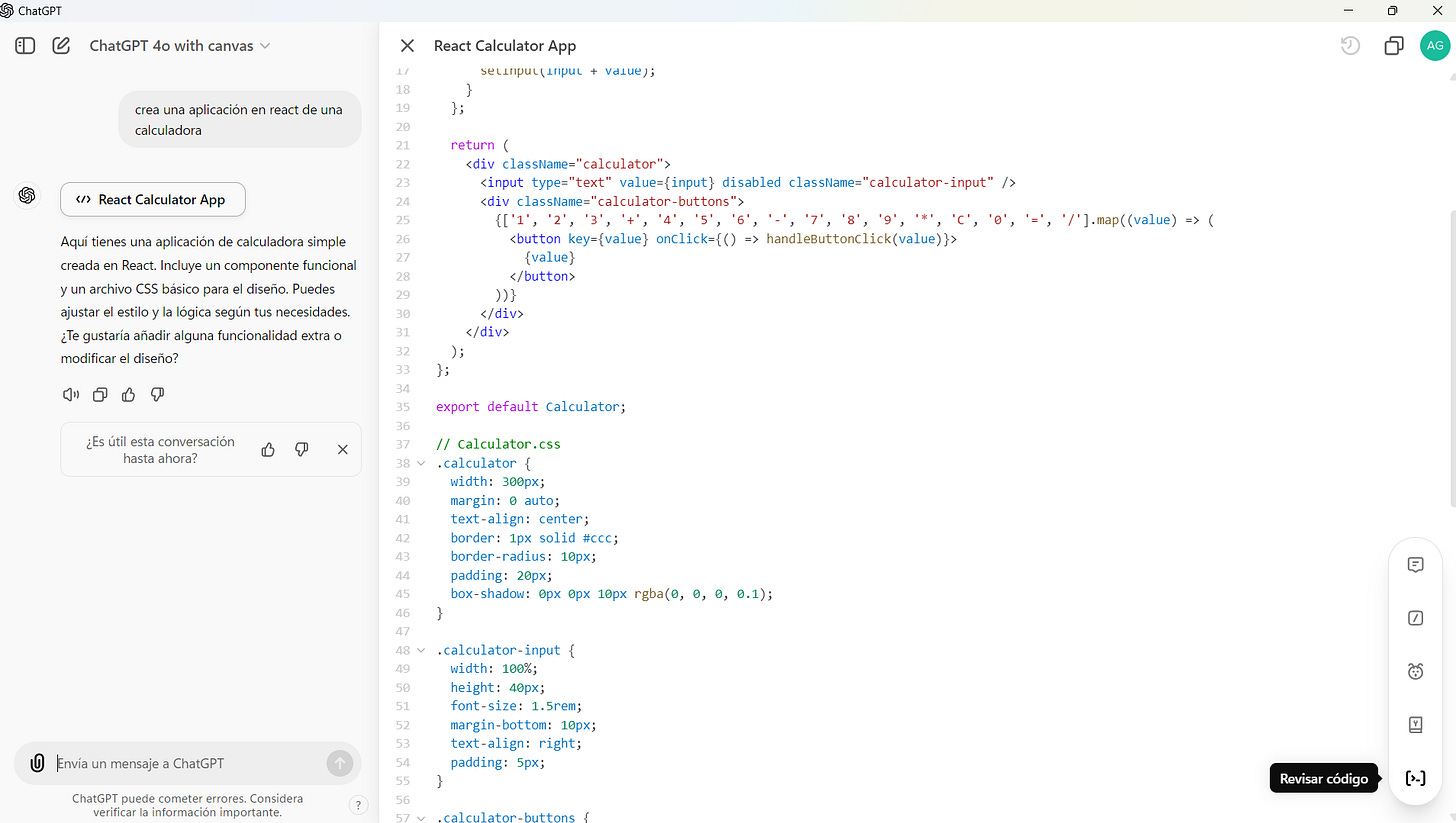

Por ejemplo, le pedí una calculadora y me armó esto en 15 o 20 segundos. Nada que no se pueda descargar desde el sandbox de la aplicación y editar con Claude (el que vimos arriba) archivo por archivo para hacerla más funcional o incluso pasarla a que sea solo HTML por ejemplo.

¿Por qué la combinación de IAs y no usar una como Claude o GPT4o1 solamente? La ventaja que tienen estas herramientas especializadas es que los primeros prompts ya están hechos y saben formatos de ejecución, tienen un tunning, entonces para MVPs o prototipos tardamos mucho menos, comprobado, y no hay que pagar nada.

Nos quedó afuera Canva de GPT

Y sí, entre las novedades de la versión anterior no lo mencioné porque quería darle más desarrollo…

La esencia es la siguiente: nos olvidamos de trabajar en un chat y pasamos a tener una nueva ventana con el resultado de lo que pedimos (código o texto), casi como trabajar con un compañero o compañera de trabajo en un proyecto (el chat se transformaría en el equivalente de Slack o WhatsApp).

Y ahí podemos modificar directamente el código o pedirle que lo revise, corrija errores, cambie el lenguaje, añada registros o comentarios todo sin tener que escribir que haga eso ni. O sea, nos ahorra bastante trabajo. Con los textos es similar, pero puede cambiar la extensión, la dificultad o nivel, agregar emojis, etc.

El chat en esa versión sigue trabajando normal, pero es más focalizado, recuerda bastante en cómo desde hace un tiempo GPT modificaba las imágenes pintando zonas que queríamos cambiar.

Según las pruebas publicadas por OpenAI, este cambio generó un aumento del 30 % en la precisión del modelo y un 16 % en la calidad de los resultados.

Sumando herramientas

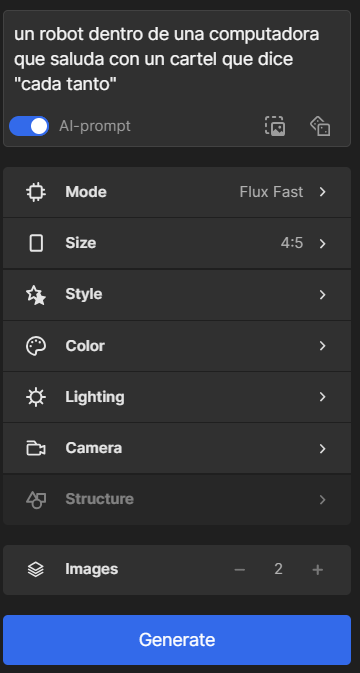

Hace un tiempo que Flux, un modelo open sourse que generó polémica cuando se lo sumó a X es una muy poderosa herramienta para la creación de imágenes (al nivel de Midjourney muchas veces).

Bueno, la podemos usar en su versión 1 en Freepik (o pagando podemos usar el 1.1) y sumamos una opción extra si se nos terminan los créditos.

Es todo por hoy, espero que les sirvan los datos y que si les gustó lo compartan con sus amigos y familia (?) En el próximo vamos a ir con algunas herramientas de video y meternos un poquito más en el paquete de Adobe.